프라이브: 수직연방학습의 사생활 보호

📝 원문 정보

- Title: PRIVEE: Privacy-Preserving Vertical Federated Learning Against Feature Inference Attacks

- ArXiv ID: 2512.12840

- 발행일: 2025-12-14

- 저자: Sindhuja Madabushi, Ahmad Faraz Khan, Haider Ali, Ananthram Swami, Rui Ning, Hongyi Wu, Jin-Hee Cho

📝 초록 (Abstract)

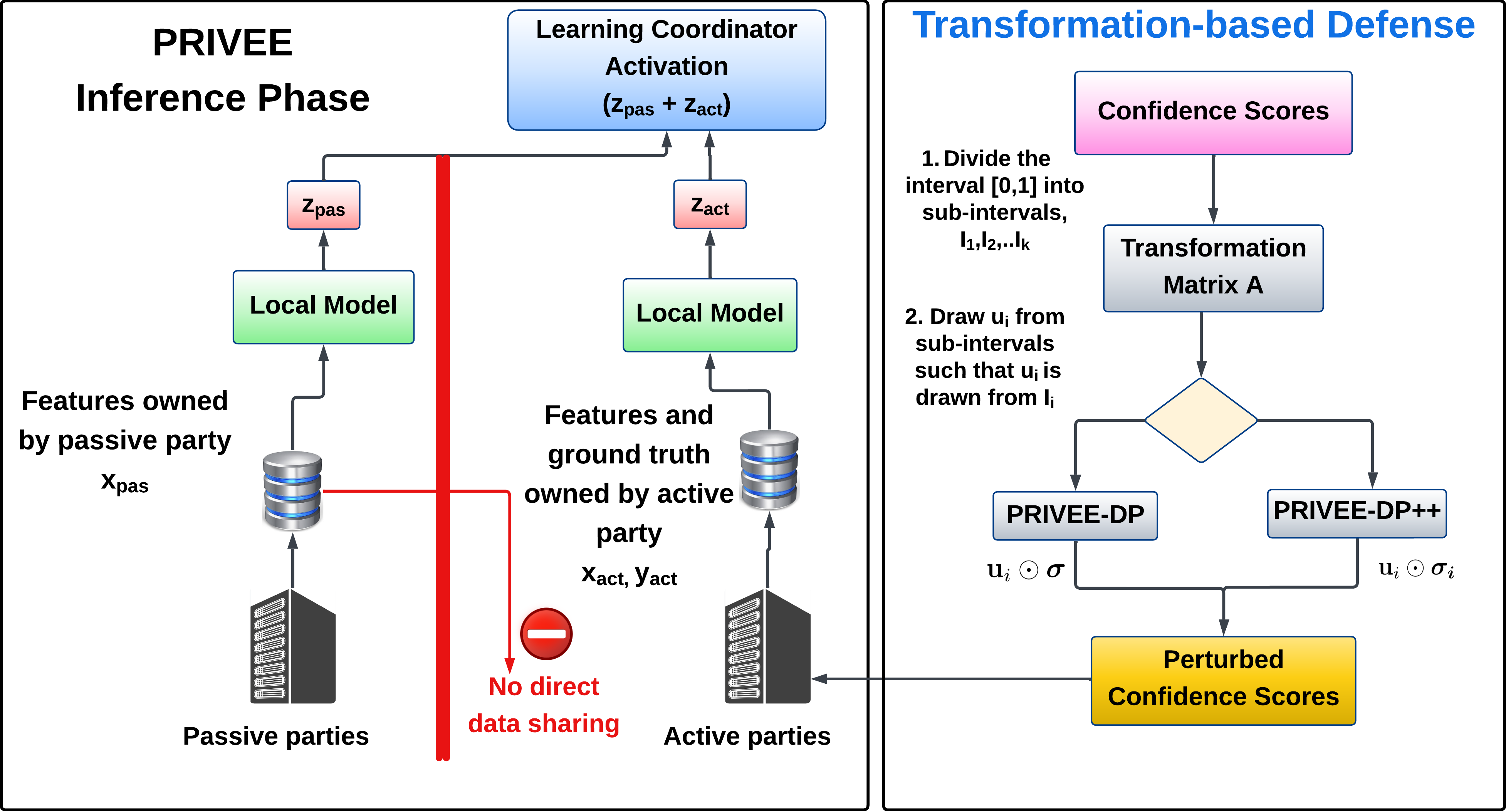

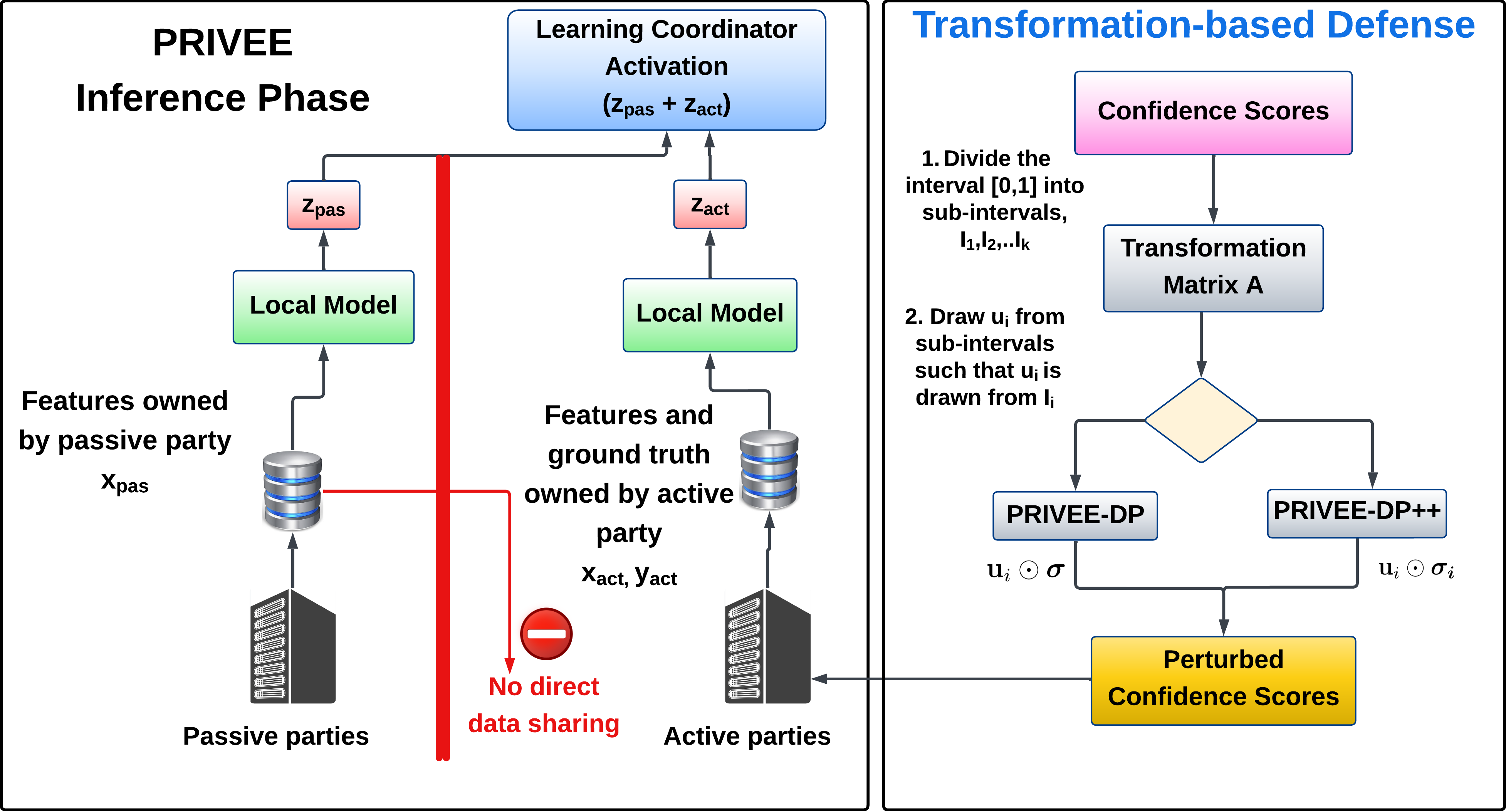

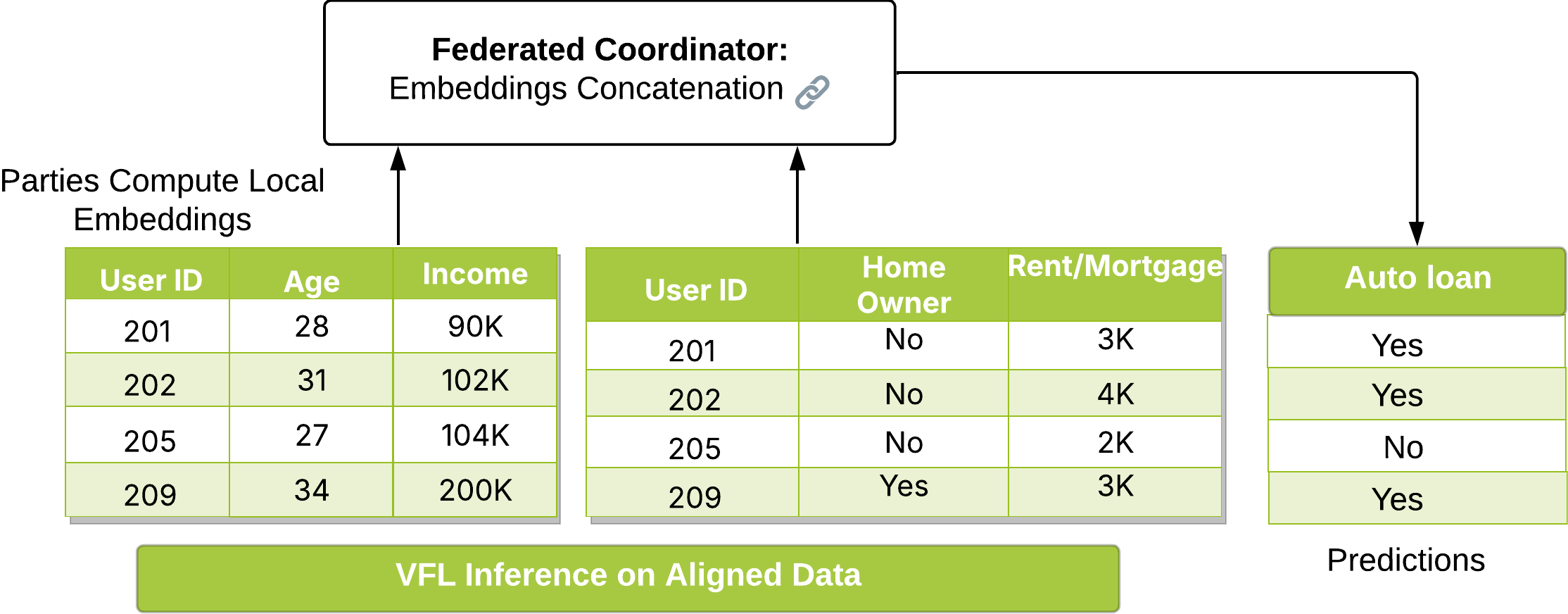

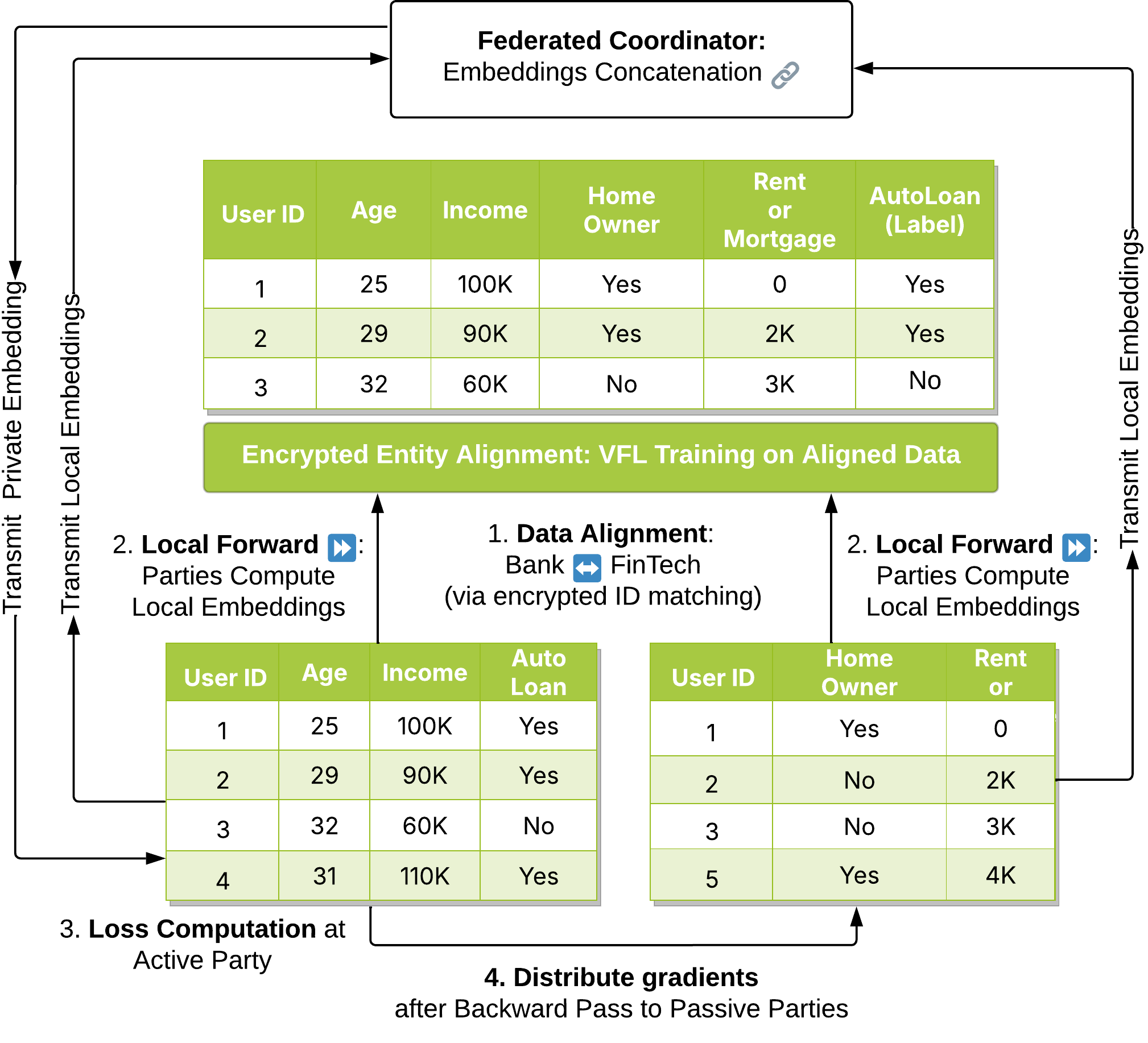

수직 연방 학습(VFL)은 공통 사용자 샘플을 공유하지만 서로 다른 특징 공간을 가진 조직 간에 협업 모델 훈련을 가능하게 합니다. 그러나 VFL은 공격자가 추론 과정에서 공유된 신뢰도 점수를 이용해 다른 참여자의 개인 입력 특징을 재구성하는 특징 추론 공격에 취약합니다. 이러한 위협에 대응하기 위해, 프라이브(PRIVEE)라는 새로운 방어 메커니즘을 제안합니다. PRIVEE는 신뢰도 점수를 암호화하면서 상대적 순위와 점수 간 거리를 유지합니다. 원시 점수를 공개하는 대신 변환된 표현만 공유하여 재구성 공격의 위험을 감소시키면서 모델 예측 정확성을 저하시키지 않습니다. 광범위한 실험 결과 PRIVEE는 최첨단 방어 기법보다 사생활 보호를 세 배 향상시켰으며, 고급 특징 추론 공격에 대해 완전한 예측 성능을 유지했습니다.💡 논문 핵심 해설 (Deep Analysis)

PRIVEE는 이 문제를 해결하기 위해 신뢰도 점수를 암호화하여 공유함으로써, 공격자가 원본 데이터를 재구성할 수 없도록 합니다. 그러나 이 과정에서 모델의 예측 성능을 유지하는 것이 중요합니다. PRIVEE는 이러한 요구사항을 충족시키기 위해 신뢰도 점수의 상대적 순위와 점수 간 거리를 보존하면서 암호화를 수행합니다.

논문은 PRIVEE가 기존 방어 메커니즘보다 세 배 더 높은 사생활 보호 수준을 제공하며, 동시에 모델의 예측 성능을 유지할 수 있다는 것을 실험적으로 입증하고 있습니다. 이러한 결과는 PRIVEE가 VFL 환경에서 사용자 데이터의 사생활을 효과적으로 보호하면서도 협업 학습의 효율성을 높일 수 있음을 시사합니다.

📄 논문 본문 발췌 (Excerpt)

📸 추가 이미지 갤러리

Reference

이 글은 ArXiv의 공개 자료를 바탕으로 AI가 자동 번역 및 요약한 내용입니다.

저작권은 원저자에게 있으며, 인류 지식 발전에 기여한 연구자분들께 감사드립니다.