Triagem virtual de imagens de imuno-histoquimica usando redes neurais artificiais e espectro de padr~oes

The importance of organizing medical images according to their nature, application and relevance is increasing. Furhermore, a previous selection of medical images can be useful to accelerate the task of analysis by pathologists. Herein this work we p…

Authors: Higor Neto Lima, Wellington Pinheiro dos Santos, M^euser Jorge Silva Valenc{c}a

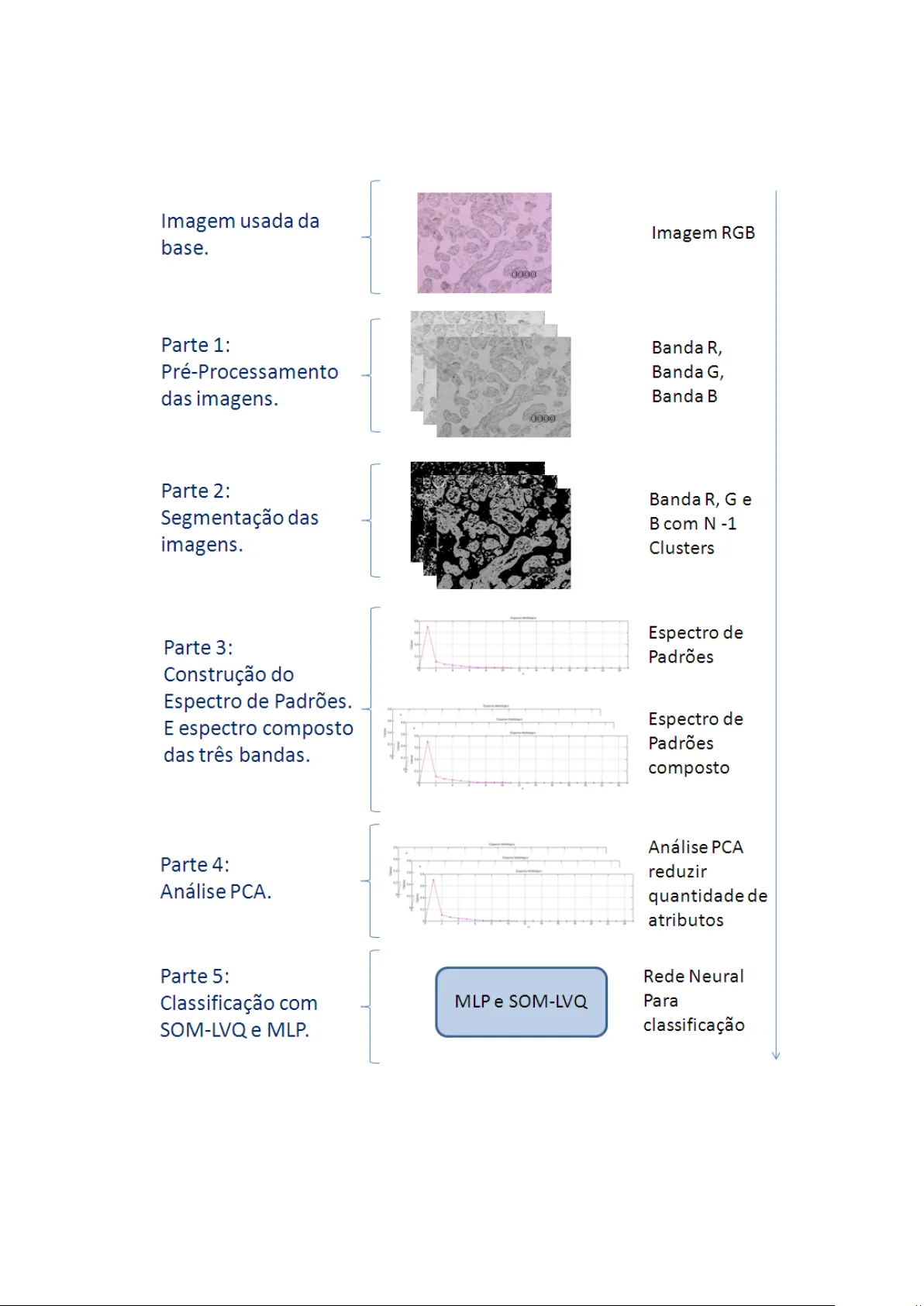

Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais TRIA GEM VIR TU AL DE IMA GENS DE IMUNO-HIST OQU ´ IMICA USANDO REDES NEURAIS AR TIFICIAIS E ESPECTR O DE P ADR ˜ OES Higor Neto Lima Escola Polit ´ ecnica de Pernambuco, Uni versidade de Pernambuco higornetto@gmail.com W ellington Pinheir o dos Santos N ´ ucleo de Engenharia Biom ´ edica, Centro de T ecnologia e Geoci ˆ encias, Univ ersidade Federal de Pernambuco wellington.santos@ufpe.br M ˆ euser Jor ge Silva V alenc ¸ a Escola Polit ´ ecnica de Pernambuco, Uni versidade de Pernambuco mjv@ecomp.poli.br Resumo – A import ˆ ancia de se organizar imagens m ´ edicas de acordo com sua natureza, aplicac ¸ ˜ ao e relev ˆ ancia tem aumen- tado. Al ´ em do mais, a selec ¸ ˜ ao pr ´ evia de imagens m ´ edicas pode ser bastante ´ util para reduzir o tempo de an ´ alise dispendido por patologistas. Neste artigo ´ e proposto um classificador de imagens para integrar um sistema de CBIR ( Content-Based Image Retrieval , Recuperac ¸ ˜ ao de Imagens Baseada em Conte ´ udo) dedicado ` a selec ¸ ˜ ao pr ´ evia de imagens, ou seja, ` a tarefa de triagem. Esse classificador ´ e baseado na representac ¸ ˜ ao das imagens de entrada pelo espectro de padr ˜ oes e na classificac ¸ ˜ ao por redes neu- rais. A selec ¸ ˜ ao dos atributos ´ e realizada aplicando a An ´ alise de Componentes Principais aos vetores de atributos obtidos pela extrac ¸ ˜ ao do espectro de padr ˜ oes, enquanto a classificac ¸ ˜ ao de imagens ´ e baseada no uso de redes neurais perceptron multicamadas e na composic ¸ ˜ ao de mapas auto-organizados e aprendizado por quantizac ¸ ˜ ao vetorial. Esses m ´ etodos foram aplicados ` a selec ¸ ˜ ao baseada em conte ´ udo de imagens de imuno-histoqu ´ ımica de placenta e pulm ˜ ao de neomortos. Os resultados demonstraram que esta abordagem pode atingir desempenhos de classificac ¸ ˜ ao razo ´ aveis. Pala vras-chave – CBIR, k-M ´ edias, Algoritmos de Agrupamento, An ´ alise de Componentes Principais, Espectro de P adr ˜ oes, Imuno-Histoqu ´ ımica. Abstract – The importance of org anizing medical images according to their nature, application and rele vance is increasing. Furhermore, a previous selection of medical images can be useful to accelerate the task of analysis by pathologists. Herein this work we propose an image classifier to integrate a CBIR (Content-Based Image Retriev al) selection system. This classifier is based on pattern spectra and neural networks. Feature selection is performed using pattern spectra and principal component analysis, whilst image classification is based on multilayer perceptrons and a composition of self-organizing maps and learning vector quantization. These methods were applied for content selection of immunohistochemical images of placenta and newde- ads lungs. Results demonstrated that this approach can reach reasonable classification performance. K eywords – CBIR, k-means, clustering algorithms, principal componente analysis, pattern spectrum, immunohistochemistry . 1 Introduc ¸ ˜ ao A velocidade de processamento dos computadores e a capacidade de armazenamento, bem como o desen volvimento de nov as m ´ ıdias de armazenamento e ev oluc ¸ ˜ ao das m ´ ıdias existentes, t ˆ em passado por um crescimento v ertiginoso desde o comec ¸ o da d ´ ecada de 1990 [1, 2]. Paralelamente, a e voluc ¸ ˜ ao das tecnologias digitais tem sido cada vez mais empregada no desen volvimento de soluc ¸ ˜ oes baseadas em processamento, armazenamento e an ´ alise de imagens digitais, o que, por sua v ez, tem demandado mais capacidade de armazenamento e representac ¸ ˜ ao de imagens [3]. Aliada a essa demanda sur ge tamb ´ em a necessidade de construir m ´ etodos de busca que permitam a pesquisa de imagens baseada em conte ´ udo [3]. Recuperac ¸ ˜ ao de Imagens Baseada em Conte ´ udo ( Content-Based Ima ge Retrieval , CBIR) ´ e uma forma de buscar imagens por meio de uma imagem-base, selecionada de acordo com o interesse do usu ´ ario. Para proporcionar a b usca baseada em conte ´ udo, ´ e preciso, portanto, representar as imagens no banco de dados de forma alternati va. Isso ´ e feito usualmente por meio da construc ¸ ˜ ao de vetores de caracter ´ ısticas que contenham os atributos de interesse para descric ¸ ˜ ao e representac ¸ ˜ ao un ´ ıvoca do conte ´ udo de interesse. As caracter ´ ısticas mais usadas s ˜ ao cor, textura e forma. A recuperac ¸ ˜ ao de imagens baseada em conte ´ udo se fundamenta em tr ˆ es premissas b ´ asicas: extrac ¸ ˜ ao de caracter ´ ısticas visuais, indexac ¸ ˜ ao multidimensional, e projeto de sistemas de recuperac ¸ ˜ ao [4]. A representac ¸ ˜ ao das imagens nos bancos de dados por meio de vetores de caracter ´ ısticas proporciona que o usu ´ ario possa buscar imagens na base de dados com o contexto requerido fazendo uso de uma imagem base, representada por seu vetor de caracter ´ ısticas. Esse v etor ´ e comparado aos vetores que representam as outras imagens no banco de dados e, por meio de medidas de similaridade, a pesquisa retorna as imagens de conte ´ udo similar [3 – 9]. Neste trabalho as imagens s ˜ ao representadas por vetores 1 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais de caracter ´ ısticas obtidos da extrac ¸ ˜ ao do espectro morfol ´ ogico de padr ˜ oes de cada uma das bandas da imagem colorida [10]. A dimensionalidade desses vetores ´ e ent ˜ ao reduzida pela aplicac ¸ ˜ ao da An ´ alise de Componentes Principais ( Principal Component Analysis , PCA). O sistema de triagem virtual proposto neste trabalho ´ e apresentado em duas vers ˜ oes: uma primeira, baseada em redes neurais MLP ( Multilayer P er ceptr on ), e uma segunda vers ˜ ao, baseada em redes SOM ( Self-Organizing Maps ) e redes L VQ ( Learning V ector Quantization ). As duas configurac ¸ ˜ oes s ˜ ao comparadas quanto ao desempenho na taref a de triagem virtual, ou seja, quanto ` a taxa de acerto de pr ´ e-classificac ¸ ˜ ao. A escolha pelo uso de redes neurais se dev e ao seu emprego em outros trabalhos en volv endo CBIR [11, 12]. Este trabalho est ´ a org anizado da forma que se gue: na sec ¸ ˜ ao ‘Materiais e M ´ etodos’ apresentam-se a teoria b ´ asica das redes neu- rais artificiais do tipo perceptron multicamadas e mapas auto-organizados de Kohonen, os princ ´ ıpios de Morfologia Matem ´ atica e a definic ¸ ˜ ao do espectro de padr ˜ oes, e a proposta de sistema de triagem virtual; em ‘Resultados Experimentais’ s ˜ ao apresenta- dos os resultados obtidos para as duas configurac ¸ ˜ oes de sistema de CBIR para triagem virtual. Por fim, na sec ¸ ˜ ao ‘Discuss ˜ ao e Conclus ˜ oes’ s ˜ ao apresentados coment ´ arios e conclus ˜ oes gerais e espec ´ ıficas lev ando em conta os resultados obtidos. 2 Materiais e M ´ etodos 2.1 Redes Per ceptron de Camada ´ Unica As redes perceptron consistem em classificadores lineares propostos por Rosenblatt que emprega neur ˆ onios MCP e uma t ´ ecnica de treinamento supervisionado baseada no aprendizado de Hebb [13, 14]. Em alguns textos tal rede ´ e considerada uma rede de duas camadas de nodos [13]. Neste trabalho, quando se referir a uma rede de M camadas, por e xemplo, ficar ´ a expl ´ ıcito se s ˜ ao M camadas de nodos ou de neur ˆ onios propriamente ditos, o que exclui a camada de nodos de entrada, que n ˜ ao e xecutam func ¸ ˜ oes matem ´ aticas, mas apenas distribuem as entradas para a primeira camada de neur ˆ onios. O treinamento de uma rede perceptron de camada ´ unica ´ e baseado no seguinte procedimento, para uma rede de m neur ˆ onios e n atributos de entrada [14]: 1. Inicializar os pesos w i,j (0) . 2. Inicializar a taxa de aprendizado η . 3. Repetir at ´ e δ ( t ) ≤ ou um m ´ aximo de N max iterac ¸ ˜ oes, onde ´ e o m ´ aximo erro permitido: (a) Para cada par ( x , d ) do conjunto de treinamento Ψ , onde Ψ = { ( x ( l ) , d ( l ) ) } L l =1 , o vetor x = ( x 1 , x 2 , . . . , x n ) T ´ e o vetor de atrib utos de entrada e d = ( d 1 , d 2 , . . . , d m ) T ´ e o vetor de sa ´ ıdas desejadas dos m neur ˆ onios, repetir: i. Calcular as sa ´ ıdas y i ( t ) dos neur ˆ onios: y i ( t ) = g n X j =1 w i,j ( t ) x j ( t ) , onde 1 ≤ i ≤ m . ii. Calcular o ajuste ∆ w i,j ( t ) : δ i ( t ) = d i ( t ) − y i ( t ) , ∆ w i,j ( t ) = η δ i ( t ) x j ( t ) , onde 1 ≤ i ≤ m e 1 ≤ j ≤ n . iii. Atualizar os pesos: w i,j ( t + 1) = w i,j ( t ) + ∆ w i,j ( t ) , onde 1 ≤ i ≤ m e 1 ≤ j ≤ n . (b) Calcular δ ( t ) da forma que segue: δ ( t ) = max( δ 1 ( t ) , δ 2 ( t ) , . . . , δ m ( t )) . As redes perceptron t ˆ em o incon veniente de apenas conv ergirem para casos linearmente separ ´ aveis, ou seja, casos em que existem hiperplanos que separam os conjuntos de entrada [15]. Essa limitac ¸ ˜ ao ´ e resolvida com as redes perceptron multicamadas. 2 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais 2.2 Redes Per ceptron Multicamadas As r edes per ceptron multicamadas foram um avanc ¸ o muito importante para o fim da estagnac ¸ ˜ ao das pesquisas em RN As, devido ` a possibilidade de, utilizando neur ˆ onios MCP e arquitetura multicamadas, resolv er problemas n ˜ ao-linearmente separ ´ aveis [13]. Elas utilizam um algoritmo chamado algoritmo de r etropr opagac ¸ ˜ ao , que consiste em uma generalizac ¸ ˜ ao do algoritmo de treinamento do perceptron de camada ´ unica atrav ´ es da estimac ¸ ˜ ao dos erros δ ( k ) i de uma camada k a partir dos erros δ ( k +1) i da camada superior k + 1 . ´ E poss ´ ıvel prov ar que, para modelagem de func ¸ ˜ oes, ´ e poss ´ ıvel modelar qualquer func ¸ ˜ ao cont ´ ınua com uma rede perceptron de duas camadas de neur ˆ onios, enquanto qualquer func ¸ ˜ ao pode ser modelada usando um perceptron de tr ˆ es camadas de neur ˆ onios, diferente das redes de camada ´ unica, que s ´ o conseguem modelar func ¸ ˜ oes cont ´ ınuas e lineares [14]. O algoritmo de retropropag ac ¸ ˜ ao, tamb ´ em chamado de r e gra delta g eneralizada , consiste no se guinte procedimento, para uma rede de M + 1 camadas de nodos, cada uma com N k nodos, sendo N 0 = n atributos de entrada e N M = m neur ˆ onios de sa ´ ıda, onde 0 ≤ k ≤ M [14]: 1. Inicializar os pesos w ( k ) i,j (0) . 2. Inicializar a taxa de aprendizado η . 3. Repetir at ´ e δ ( t ) ≤ ou um m ´ aximo de N max iterac ¸ ˜ oes, onde ´ e o m ´ aximo erro permitido: (a) Para cada par ( x , d ) do conjunto de treinamento Ψ , onde Ψ = { ( x ( l ) , d ( l ) ) } L l =1 , o vetor x = ( x 1 , x 2 , . . . , x n ) T ´ e o vetor de atrib utos de entrada e d = ( d 1 , d 2 , . . . , d m ) T ´ e o vetor de sa ´ ıdas desejadas dos N ( M ) = m neur ˆ onios de sa ´ ıda, repetir: i. Calcular as sa ´ ıdas y ( k ) i ( t ) dos neur ˆ onios: y ( k ) i ( t ) = g N k − 1 X j =1 w ( k ) i,j ( t ) x ( k ) j ( t ) , onde 1 ≤ i ≤ N k e x ( k ) j ( t ) = y ( k − 1) j ( t ) , onde 1 ≤ k ≤ M e y (0) j ( t ) = x j ( t ) , para 1 ≤ j ≤ N k − 1 , N 0 = n e N M = m . ii. Calcular os erros da camada de sa ´ ıda: δ ( M ) i ( t ) = ( d i ( t ) − y ( M ) i ( t )) g 0 ( y ( M ) i ( t )) , onde 1 ≤ i ≤ N M e g 0 ( ) ´ e a deriv ada de g ( ) . iii. Calcular os erros das outras camadas: δ ( k ) i ( t ) = g 0 ( y ( k ) i ( t )) N k +1 X j =1 w ( k +1) j,i ( t ) δ ( k +1) j ( t ) , onde 1 ≤ i ≤ N k e 1 ≤ k ≤ M − 1 . iv . Calcular os ajustes ∆ w ( k ) i,j ( t ) : ∆ w ( k ) i,j ( t ) = η δ ( k ) i ( t ) x ( k ) j ( t ) , onde 1 ≤ i ≤ N k , 1 ≤ j ≤ N k − 1 e 1 ≤ k ≤ M . v . Atualizar os pesos: w ( k ) i,j ( t + 1) = w ( k ) i,j ( t ) + ∆ w ( k ) i,j ( t ) , onde 1 ≤ i ≤ N k , 1 ≤ j ≤ N k − 1 e 1 ≤ k ≤ M . (b) Calcular δ ( t ) da forma que segue: δ ( t ) = max( δ ( M ) 1 ( t ) , δ ( M ) 2 ( t ) , . . . , δ ( M ) N M ( t )) . 3 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais As func ¸ ˜ oes de ativ ac ¸ ˜ ao dos neur ˆ onios nas redes perceptron multicamadas de vem ser cont ´ ınuas, monotonicamente crescentes e diferenci ´ aveis [16]. Existem outras vers ˜ oes do algoritmo de retropropagac ¸ ˜ ao onde os ajustes dos pesos s ˜ ao calculados segundo outros m ´ etodos, mas o princ ´ ıpio b ´ asico ´ e o mesmo, estando a diferenc ¸ a apenas em quest ˜ oes como a rapidez da con ver g ˆ encia e outras quest ˜ oes cuja natureza e interesse dependem da aplicac ¸ ˜ ao. 2.3 Redes SOM Os mapas auto-or ganizados de K ohonen foram originalmente desenv olvidos para fazer agrupamento de dados. T amb ´ em chamados de redes SOM ( Self-Or ganizing Maps ) [14], os mapas auto-org anizados possuem uma arquitetura bastante diferente das redes neurais usuais: neles os neur ˆ onios podem ser dispostos matricialmente, tentando emular a distribuic ¸ ˜ ao dos neur ˆ onios biol ´ ogicos no c ´ erebro. Nas redes SOM os neur ˆ onios podem ser dispostos de forma linear ou matricial, em todas as dimens ˜ oes poss ´ ıveis, sendo que a quantidade de vizinhos influencia apenas na etapa de aprendizado, estabelecendo depend ˆ encias entre o ajuste dos pesos de um neur ˆ onio e os pesos de seus vizinhos, se gundo uma determinada func ¸ ˜ ao de vizinhanc ¸ a, como se mostra na descric ¸ ˜ ao do processo de aprendizado. No processo de aprendizado, ´ areas espec ´ ıficas de neur ˆ onios v ˜ ao sendo ativ adas. Ao final do processo, a rede SOM fica dividida em ´ areas especialistas, respons ´ aveis pela classificac ¸ ˜ ao de padr ˜ oes espec ´ ıficos, semelhante ao c ´ erebro, onde cada regi ˜ ao ´ e respons ´ avel por uma ati vidade espec ´ ıfica. Os mapas auto-organizados utilizam neur ˆ onios suja sa ´ ıda ´ e a que segue: y i = e −|| x − w i || 2 , (1) onde w i = ( w i, 1 , w i, 2 , . . . , w i,n ) T ´ e o vetor de pesos do i - ´ esimo neur ˆ onio, para 1 ≤ i ≤ m e 1 ≤ j ≤ n . Os pesos das redes SOM podem ser ajustados pelo seguinte procedimento modificado, baseado no procedimento cl ´ assico de ajuste de redes SOM, mas tendo como crit ´ erios de parada o n ´ umero m ´ aximo de iterac ¸ ˜ oes e a soma dos ajustes dos pesos: 1. Inicializar os pesos w i,j (0) , onde 1 ≤ i ≤ m e 1 ≤ j ≤ n , com valores aleat ´ orios e necessariamente diferentes. 2. Entrar com os vetores posic ¸ ˜ ao r i , correspondentes ` a posic ¸ ˜ ao do i- ´ esimo neur ˆ onio na grade, onde 1 ≤ i ≤ m . 3. Inicializar a taxa de aprendizado inicial η 0 , onde 0 < η 0 < 1 . 4. Inicializar a largura topol ´ ogica σ 0 . A largura topol ´ ogica ´ e a largura da func ¸ ˜ ao de vizinhanc ¸ a gaussiana h i,k ( t ) , utilizada para definir a vizinhanc ¸ a do neur ˆ onio vencedor a ser treinada. 5. Repetir at ´ e δ ( t ) = 0 ou um m ´ aximo de N max iterac ¸ ˜ oes: (a) Para cada padr ˜ ao x = ( x 1 , x 2 , . . . , x n ) T do conjunto de entrada Ψ = { x ( l ) } L l =1 , repetir: i. Calcular as sa ´ ıdas y i ( t ) dos neur ˆ onios, onde 1 ≤ i ≤ m . ii. Calcular y max ( t ) : y max ( t ) = max( y 1 ( t ) , y 2 ( t ) , . . . , y m ( t )) . iii. Calcular o ´ ındice k do neur ˆ onio vencedor: y i = y max ⇒ k = i. iv . Calcular o ajuste ∆ w i,j ( t ) : ∆ w i,j ( t ) = η ( t ) h i,k ( t )( x j ( t ) − w i,j ( t )) , onde 1 ≤ i ≤ m e 1 ≤ j ≤ n . v . Atualizar os pesos: w i,j ( t + 1) = w i,j ( t ) + ∆ w i,j ( t ) , onde: σ ( t ) = σ 0 exp − t τ 1 , h i,k ( t ) = exp − d 2 i,k 2 σ 2 ( t ) ! , η ( t ) = η 0 exp − t τ 2 , onde τ 1 e τ 2 s ˜ ao constantes de tempo e: d i,k = || r i − r k || , para 1 ≤ i ≤ m e 1 ≤ j ≤ n . 4 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais (b) Calcular δ ( t ) da forma que segue: δ ( t ) = m X i =1 n X j =1 | ∆ w i,j ( t ) | . As redes SOM podem ser utilizadas tamb ´ em como etapa de classificac ¸ ˜ ao ou agrupamento de dados para uma RNA supervi- sionada [13, 14, 17], tendo div ersas aplicac ¸ ˜ oes potenciais em reconhecimento de padr ˜ oes na Engenharia Biom ´ edica como, por ex emplo, o aux ´ ılio ao diagn ´ ostico da epilepsia a partir de sintomas [18]. 2.4 Classificador L VQ de Kohonen O algoritmo L VQ , ou algoritmo de quantizac ¸ ˜ ao vetorial por aprendizagem (L VQ, Learning V ector Quantization ) consiste em uma t ´ ecnica supervisionada de treinamento que tanto pode ser utilizada para adicionar novos padr ˜ oes a uma rede SOM j ´ a treinada quanto permite criar uma rede neural supervisionada com a mesma arquitetura de uma rede SOM [14, 19]. Dado o conjunto de treinamento Ψ = { x ( l ) , C ( l ) } L l =1 , onde C ( l ) ´ e a classe correta a priori , calcula-se a sa ´ ıda da rede para cada elemento x de Ψ pertencente ` a classe C e, caso o neur ˆ onio vencedor seja o i - ´ esimo, considerando que este neur ˆ onio est ´ a associado ` a classe C i , para uma rede de n entradas e m sa ´ ıdas projetada para reconhecer padr ˜ oes de um universo Ω = { C 1 , C 2 , . . . , C m } , onde 1 ≤ i ≤ m , os pesos ser ˜ ao atualizados da forma que segue [14, 19]: w i,j ( t + 1) = w i,j ( t ) + η ( t )( x j ( t ) − w i,j ( t )) , C i = C w i,j ( t ) − η ( t )( x j ( t ) − w i,j ( t )) , C i 6 = C , (2) onde 1 ≤ j ≤ n e η ´ e a taxa de aprendizado. A inicializac ¸ ˜ ao da rede L VQ ´ e id ˆ entica ` a da rede SOM. A rede L VQ pode usar como crit ´ erio de parada tanto o n ´ umero de iterac ¸ ˜ oes quanto o erro de classificac ¸ ˜ ao, dado que o treinamento ´ e supervisionado. 2.5 Morfologia Matem ´ atica e Espectro de P adr ˜ oes Uma imagem f : S → K ´ e definida como sendo a func ¸ ˜ ao que mapeia um vetor bidimensional u ∈ S no ponto f ( u ) ∈ K , onde S ´ e a grade ou suporte da imagem, u ´ e o pixel da grade S ; f ( u ) ∈ K ´ e o valor do pixel u ∈ S . De forma mais rigorosa, [20] define pixel como sendo o par ( u, f ( u )) , ou seja, o vetor formado pela sua posic ¸ ˜ ao u na grade S e seu valor associado f ( u ) . J ´ a K ´ e o conjunto dos valores poss ´ ıveis de f ( u ) . Denota-se K S o conjunto de todas as imagens poss ´ ıveis na grade S em K [20]. Quando a grade S ´ e discr eta , isto ´ e, S ⊆ Z 2 , diz-se que f : S → K ´ e uma imagem discreta . K ´ e definido como sendo da forma K = V p , onde V ∈ R ´ e o conjunto dos n ´ ıveis de cinza e p ∈ N ∗ ´ e o n ´ umer o de bandas presentes na imagem f . Assim, seja f uma imagem de p bandas f : S → V p , f pode ser denotada de forma equiv alente por f ( u ) = { f 1 ( u ) , f 2 ( u ) , . . . , f p ( u ) } , u ∈ S, onde f j ( u ) ´ e a j - ´ esima banda de f : S → V p , para f j : S → V e 1 ≤ j ≤ p . Quando p = 1 diz-se que a imagem ´ e uma imagem em n ´ ıveis de cinza ou monocr om ´ atica . Uma imagem ´ e dita ser uma imagem colorida quando p = 3 e multiespectral quando 4 ≤ p ≤ 100 [21]. J ´ a uma imagem ´ e dita hiperespectr al quando p > 100 [21]. Para generalizar , pode-se dizer que uma imagem ´ e multiespectral quando p > 1 . Uma imagem f : S → K ´ e dita ser uma imagem digital quando, al ´ em de ser discreta, ela ´ e quantizada , ou seja, seus pixels assumem apenas vetores discretos. Matematicamente, f : S → K ´ e uma imagem digital quando K = { 0 , 1 , . . . , k } p e S ∈ Z , onde p ∈ N ∗ . Quando uma imagem digital ´ e representada com N bits, k = 2 N − 1 . Assim, uma imagem digital f : S → K de 8 bits tem K = { 0 , 1 , . . . , 255 } p , enquanto que imagens digitais de 16 bits tem K = { 0 , 1 , . . . , 65535 } p . Conseq ¨ uentemente, uma ima gem bin ´ aria de banda ´ unica f : S → K ´ e uma imagem digital com K = { 0 , 1 } . Por uma quest ˜ ao de con veni ˆ encia, ´ e comum representar as imagens digitais como imagens discretas normalizadas, substi- tuindo K = { 0 , 1 , . . . , k } p por K = [0 , 1] p . Desta forma n ˜ ao ´ e preciso explicitar quantos bits s ˜ ao utilizados na representac ¸ ˜ ao dos valores poss ´ ıveis dos pixels . Assim, uma imagem f : S → { 0 , 1 , . . . , k } p passa a ser representada por ˜ f : S → [0 , 1] p . ´ E importante realc ¸ ar que as imagens bin ´ arias s ˜ ao apenas casos particulares das imagens em n ´ ıveis de cinza. Assim, uma imagem bin ´ aria f : S → { 0 , k } p passa a ser denotada utilizando a notac ¸ ˜ ao normalizada por ˜ f : S → { 0 , 1 } p . Salvo indicac ¸ ˜ ao em contr ´ ario, neste texto uma imagem f : S → K sempre ser ´ a representada por sua vers ˜ ao normalizada, sendo K S o conjunto de todas as imagens normalizadas, onde K = [0 , 1] p , para p bandas. Usualmente S ´ e uma regi ˜ ao r etangular de Z 2 , podendo-se representar as imagens digitais em n ´ ıvel de cinza f : S → { 0 , 1 , . . . , k } como matrizes [22, 23]. [23] representaria uma imagem f : S → V da seguinte forma, para S sendo uma grade m × n centrada em ( r , s ) : f = a 11 a 12 · · · a 1 n a 21 a 22 · · · a 2 n . . . . . . . . . . . . a m 1 a m 2 · · · a mn ( r,s ) , 5 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais onde a ij ∈ V , para 1 ≤ i ≤ m e 1 ≤ j ≤ n . Isto implica dizer que, segundo esta notac ¸ ˜ ao: f ( u ) = a ij ⇒ u = ( i − r, j − s ) , u ∈ S. Note que, neste caso, a grade S ´ e uma regi ˜ ao retangular de Z 2 do tipo: S = { (1 − r ) , (2 − r ) , . . . , ( m − r ) } × { (1 − s ) , (2 − s ) , . . . , ( n − s ) } . Esta ser ´ a a notac ¸ ˜ ao utilizada ao longo deste texto sempre que for con veniente representar uma imagem como uma matriz. As operac ¸ ˜ oes b ´ asicas entre imagens em Morfologia Matem ´ atica s ˜ ao a comparac ¸ ˜ ao , a subtrac ¸ ˜ ao , a intersecc ¸ ˜ ao e a uni ˜ ao . ´ E importante afirmar que as operac ¸ ˜ oes b ´ asicas da Morfologia Matem ´ atica s ´ o podem ser aplicadas a imagens que mantenham uma relac ¸ ˜ ao de ordem entre os pixels . Somente as imagens em n ´ ıveis de cinza e as imagens bin ´ arias mant ˆ em tal relac ¸ ˜ ao. No caso das imagens multiespectrais ou hiperespectrais, ´ e necess ´ ario trabalhar banda a banda ou supor algum artif ´ ıcio para manter a relac ¸ ˜ ao de ordem. A relac ¸ ˜ ao de ordem ´ e a base da Morfologia Matem ´ atica [20]. Dadas duas imagens f 1 : S → [0 , 1] e f 2 : S → [0 , 1] , a comparac ¸ ˜ ao 5 ´ e a operac ¸ ˜ ao de [0 , 1] S × [0 , 1] S em [0 , 1] S definida como segue [20]: ( f 1 5 f 2 )( u ) = 1 , f 1 ( u ) ≤ f 2 ( u ) 0 , c.c. , ∀ u ∈ S. (3) Dada uma imagem f : S → [0 , 1] , o ne gativo de f , denotado por f ou ∼ f , ´ e o operador de [0 , 1] S em [0 , 1] S definido como sendo [24]: f ( u ) = 1 − f ( u ) , ∀ u ∈ S. (4) A uni ˜ ao entre f 1 : S → [0 , 1] e f 2 : S → [0 , 1] ´ e o operador de [0 , 1] S × [0 , 1] S em [0 , 1] S , denotado f 1 ∨ f 2 , definido como segue [20]: ( f 1 ∨ f 2 )( u ) = max { f 1 ( u ) , f 2 ( u ) } , ∀ u ∈ S. (5) A intersecc ¸ ˜ ao entre f 1 : S → [0 , 1] e f 2 : S → [0 , 1] ´ e o operador de [0 , 1] S × [0 , 1] S em [0 , 1] S , denotado f 1 ∧ f 2 , definido como [20]: ( f 1 ∧ f 2 )( u ) = min { f 1 ( u ) , f 2 ( u ) } , ∀ u ∈ S. (6) Pode-se notar que as operac ¸ ˜ oes de uni ˜ ao e intersecc ¸ ˜ ao entre imagens se assemelham ` as operac ¸ ˜ oes de mesmo nome entre conjuntos neb ulosos. A semelhanc ¸ a entre estas operac ¸ ˜ oes da Morfologia Matem ´ atica e da L ´ ogica Neb ulosa cresce com a adoc ¸ ˜ ao da notac ¸ ˜ ao de imagem normalizada, o que faz com que, de certa forma, as imagens normalizadas se assemelhem a conjuntos nebulosos. A subtrac ¸ ˜ ao ou difer enc ¸ a entre f 1 : S → [0 , 1] e f 2 : S → [0 , 1] ´ e operac ¸ ˜ ao de [0 , 1] S × [0 , 1] S em [0 , 1] S dada por [24]: ( f 1 ∼ f 2 )( u ) = ( f 1 ∧ f 2 )( u ) , ∀ u ∈ S. (7) A partir destas operac ¸ ˜ oes ´ e poss ´ ıvel definir os operador es b ´ asicos da Morfologia Matem ´ atica: a dilatac ¸ ˜ ao , a er os ˜ ao , o gr adi- ente morfol ´ ogico , a abertura , o fechamento , as aberturas e fechamentos por r econstruc ¸ ˜ ao e as dilatac ¸ ˜ oes e er os ˜ oes condicionais . Pode-se dizer que a Morfologia Matem ´ atica ´ e uma teoria construtiva , devido ao fato de que operadores mais complexos podem ser constru ´ ıdos a partir dos mais simples. Destes, os operadores fundamentais s ˜ ao a dilatac ¸ ˜ ao e a er os ˜ ao , originando-se todos os outros a partir de combinac ¸ ˜ oes destes [25]. A dilatac ¸ ˜ ao de f : S → [0 , 1] por g : S → [0 , 1] , denotada δ g ( f ) ou f ⊕ g (soma de Minkowsk y , no caso bin ´ ario [20]), ´ e um operador de [0 , 1] S × [0 , 1] S em [0 , 1] S definido como: δ g ( f )( u ) = ( f ⊕ g )( u ) := _ v ∈ S f ( v ) ∧ g ( u − v ) , ∀ u ∈ S, (8) onde g ´ e denominado elemento estruturante . Na pr ´ atica, a dilatac ¸ ˜ ao transforma a imagem original de forma a fazer o elemento estruturante se “encaixar” na imagem, ou seja, a imagem original f ser ´ a modificada de modo a fazer as ´ areas semelhantes a g “crescerem”, “encaixando” g . V isualmente, a dilatac ¸ ˜ ao resulta no crescimento das ´ ar eas claras e na eliminac ¸ ˜ ao das ´ ar eas escuras menores do que o elemento estruturante , considerando o fato de que, usualmente, os pixels mais claros s ˜ ao representados por v alores mais pr ´ oximos de 1 , enquanto os mais escuros, por valores mais pr ´ oximos de 0 . A er os ˜ ao de f : S → [0 , 1] por g : S → [0 , 1] , denotada g ( f ) ou f g (subtrac ¸ ˜ ao de Minkowsk y , no caso bin ´ ario [20]), ´ e um operador de [0 , 1] S × [0 , 1] S em [0 , 1] S definido como: g ( f )( u ) = ( f g )( u ) := ^ v ∈ S f ( v ) ∨ g ( v − u ) , ∀ u ∈ S. (9) Na pr ´ atica, a eros ˜ ao transforma a imagem original f de modo a fazer as ´ areas semelhantes a g “diminuirem”, “encaixando” g , conforme o exemplo anterior . 6 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais T abela 1: Operac ¸ ˜ oes de dilatac ¸ ˜ ao, eros ˜ ao e con voluc ¸ ˜ ao Operac ¸ ˜ ao Expr ess ˜ ao Dilatac ¸ ˜ ao ( f ⊕ g )( u ) = W v ∈ S f ( v ) ∧ g ( u − v ) Eros ˜ ao ( f g )( u ) = V v ∈ S f ( v ) ∨ g ( v − u ) Con voluc ¸ ˜ ao ( f ∗ g )( u ) = P v ∈ S f ( v ) g ( u − v ) V isualmente, a eros ˜ ao resulta no cr escimento das ´ ar eas escuras e na eliminac ¸ ˜ ao das ´ ar eas claras menor es do que o elemento estruturante , considerando o fato de que, usualmente, os pixels mais claros s ˜ ao representados por v alores mais pr ´ oximos de 1 , enquanto os mais escuros, mais pr ´ oximos de 0 . Em [24] a dilatac ¸ ˜ ao e a eros ˜ ao s ˜ ao mostradas esquematicamente por meio de ex emplos e ilustrac ¸ ˜ oes, que mostram o elemento estruturante percorrendo uma imagem bin ´ aria. ´ E uma abordagem bastante ilustrati va, que d ´ a ao leitor uma id ´ eia de como s ˜ ao implementadas de forma algor ´ ıtmica a dilatac ¸ ˜ ao e a eros ˜ ao. A T abela 1 mostra as express ˜ oes das operac ¸ ˜ oes de dilatac ¸ ˜ ao , er os ˜ ao e con voluc ¸ ˜ ao , podendo-se perceber a semelhanc ¸ a entre estas tr ˆ es operac ¸ ˜ oes. Quanto ` as suas propriedades, a dilatac ¸ ˜ ao ´ e uma operac ¸ ˜ ao extensiva de vido ao fato de δ g ( f )( u ) ≥ f ( u ) , ∀ u ∈ S , enquanto que a er os ˜ ao ´ e uma operac ¸ ˜ ao anti-extensiva , pois g ( f )( u ) ≤ f ( u ) , ∀ u ∈ S [10]. A anti-dilatac ¸ ˜ ao de f : S → [0 , 1] por g : S → [0 , 1] , denotada por δ a g ( f ) , ´ e dada por: δ a g ( f )( u ) := δ g ( f )( u ) , ∀ u ∈ S. (10) A anti-er os ˜ ao de f : S → [0 , 1] por g : S → [0 , 1] , denotada por a g ( f ) , ´ e dada por: a g ( f )( u ) := g ( f )( u ) , ∀ u ∈ S. (11) A n -dilatac ¸ ˜ ao de f : S → [0 , 1] por g : S → [0 , 1] , denotada por δ n g ( f ) , ´ e dada por , para n > 1 : δ n g ( f )( u ) := δ g δ g · · · δ g | {z } n ( f )( u ) , ∀ u ∈ S. (12) De forma semelhante, a n -er os ˜ ao de f : S → [0 , 1] por g : S → [0 , 1] , denotada por n g ( f ) , ´ e dada por , para n > 1 : n g ( f )( u ) := g g · · · g | {z } n ( f )( u ) , ∀ u ∈ S. (13) O elemento estruturante quadrado 3 × 3 ´ e dado por: b = 1 1 1 1 1 1 1 1 1 (2 , 2) . O elemento estruturante cruz 3 × 3 ´ e dado por: b = 0 1 0 1 1 1 0 1 0 (2 , 2) . Em [24] ´ e demonstrado que qualquer elemento estruturante de dimens ˜ oes maiores que 3 × 3 pode ser decomposto em v ´ arios 3 × 3 . Isto quer dizer que uma dilatac ¸ ˜ ao por um elemento estruturante h de dimens ˜ oes m × n , tal que m > 3 e n > 3 , pode ser ex ecutada por meio de um certo n ´ umero de dilatac ¸ ˜ oes por b k de dimens ˜ oes 3 × 3 , onde cada b k ´ e um elemento estruturante que constitui h [24]. Uma das aplicac ¸ ˜ oes mais importantes da Morfologia Matem ´ atica ´ e a implementac ¸ ˜ ao de filtr os morfol ´ ogicos , os quais con- sistem em filtros n ˜ ao lineares baseados em operac ¸ ˜ oes morfol ´ ogicas. Os filtros morfol ´ ogicos mais comuns s ˜ ao a abertura , o fechamento , a n -abertur a , o n -fechamento e os filtr os alternados . Segundo [20], uma transformac ¸ ˜ ao ξ ´ e um filtr o morfol ´ ogico se for ao mesmo tempo idempotente e cr escente . A transformac ¸ ˜ ao ξ ´ e cr escente se, dadas duas imagens f : S → K e g : S → K , a seguinte condic ¸ ˜ ao ´ e satisfeita [20]: f ( u ) ≤ g ( u ) ⇒ ξ ( f )( u ) ≤ ξ ( g )( u ) , ∀ u ∈ S. (14) Por sua vez, a transformac ¸ ˜ ao ξ ´ e idempotente se [20]: ξ ξ ( f )( u ) = ξ ( f )( u ) , ∀ u ∈ S, (15) 7 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais ou seja, se ξ ´ e idempotente, a imagem f n ˜ ao ´ e alterada por aplicac ¸ ˜ oes sucessiv as da mesma transformac ¸ ˜ ao ξ . O filtro morfol ´ ogico de abertura ´ e utilizado para “eliminar” regi ˜ oes claras na imagem que n ˜ ao possam estar contidas no elemento estruturante. Assim, a abertura realiza na imagem uma esp ´ ecie de “peneiramento” dos pontos claros. Como resultado, fazendo uma analogia entre uma imagem em n ´ ıveis de cinza e um relev o topogr ´ afico, os picos (pontos de m ´ aximo ou regi ˜ oes mais claras) inferiores em tamanho ao elemento estruturante s ˜ ao “eliminados”. Matematicamente, a abertur a de f : S → [0 , 1] pelo elemento estruturante g : S → [0 , 1] , denotada γ g ( f ) , ´ e a transformac ¸ ˜ ao de [0 , 1] S em [0 , 1] S definida por [20]: γ g ( f ) := δ g g ( f ) . (16) A abertura γ g ( f ) ´ e uma transformac ¸ ˜ ao anti-extensiva , pois: γ g ( f )( u ) ≤ f ( u ) , ∀ u ∈ S. (17) O filtro morfol ´ ogico de fechamento ´ e utilizado para “eliminar” regi ˜ oes escuras na imagem que n ˜ ao possam estar contidas no elemento estruturante. Assim, o fechamento realiza na imagem uma esp ´ ecie de “peneiramento” dos pontos escuros. Como resultado, no vamente utilizando uma analogia entre uma imagem em n ´ ıveis de cinza e um rele vo topogr ´ afico, os vales (pontos de m ´ ınimo ou regi ˜ oes mais escuras) inferiores em tamanho ao elemento estruturante s ˜ ao “eliminados”. Matematicamente, o fechamento de f : S → [0 , 1] pelo elemento estruturante g : S → [0 , 1] , denotado φ g ( f ) , ´ e a transformac ¸ ˜ ao de [0 , 1] S em [0 , 1] S definida da forma que segue [20]: φ g ( f ) := g δ g ( f ) . (18) O fechamento φ g ( f ) ´ e uma transformac ¸ ˜ ao extensiva , pois: f ( u ) ≤ φ g ( f )( u ) , ∀ u ∈ S. (19) A n -abertura de f : S → [0 , 1] por g : S → [0 , 1] , denotada γ n g ( f ) , ´ e definida da forma que segue [20]: γ n g ( f ) := δ n g n g ( f ) . (20) O n -fechamento de f : S → [0 , 1] por g : S → [0 , 1] , denotado φ n g ( f ) , ´ e definido como segue [20]: φ n g ( f ) := n g δ n g ( f ) . (21) Dentre as ferramentas da Morfologia Matem ´ atica para a descric ¸ ˜ ao de tamanho e forma em an ´ alise de imagens, as gra- nulometrias constituem algumas das mais utilizadas. A id ´ eia b ´ asica de uma granulometria ´ e realizar div ersas crivagens (ou peneiramentos ) seguidas de medic ¸ ˜ oes quantitati vas dos res ´ ıduos, tais como medic ¸ ˜ ao de ´ area ou per ´ ımetro. Ou seja, realiza-se um peneiramento da imagem original utilizando uma certa peneira e depois medem-se os gr ˜ aos que passaram; em seguida, utiliza-se uma peneira com fur os menores e novamente se medem os res ´ ıduos, e assim por diante. No caso, o tamanho dos fur os da peneir a ´ e determinado pela dimens ˜ ao do elemento estruturante utilizado na transformac ¸ ˜ ao granulom ´ etrica. A fam ´ ılia de transformac ¸ ˜ oes { ψ j } , parametrizadas com um par ˆ ametro j ≥ 0 , onde ψ 0 ( f )( u ) = f ( u ) , ∀ u ∈ S, f : S → [0 , 1] , ´ e chamada de uma granulometria se constituir um crit ´ erio de forma [10], ou seja: ψ j ( f )( u ) ≤ f ( u ) , (22) f ( u ) ≤ g ( u ) ⇒ ψ j ( f )( u ) ≤ ψ j ( g )( u ) , (23) ψ j [ ψ k ( f )]( u ) = ψ k [ ψ j ( f )]( u ) = ψ max( j,k ) ( f )( u ) , ∀ j, k ≥ 0 , (24) ∀ u ∈ S , onde g : S → [0 , 1] . A ´ ultima condic ¸ ˜ ao e xpressa a id ´ eia intuiti va de que dois peneiramentos se guidos s ˜ ao equi valentes a um s ´ o peneir amento com a peneira de bur acos menores ( max( j, k ) ), j ´ a que o ´ ındice j da transformac ¸ ˜ ao ψ j expressa o rigor do peneiramento : quanto maior o j , mais rigoroso o peneiramento , ou seja, menores os gr ˜ aos passantes. ´ E poss ´ ıvel demonstrar que o conjunto de transformac ¸ ˜ oes morfol ´ ogicas que constitui um crit ´ erio de forma ´ e o conjunto das j -aberturas por um elemento estruturante disco digital [10]. Os discos digitais mais elementares s ˜ ao o quadrado 3 × 3 e a cruz 3 × 3 [10]. Assim, { γ j g } ´ e uma granulometria , onde j ≥ 0 e g ´ e um disco digital. Logo, uma granulometria passa a ser expressa da forma { ψ j = γ j g } , r ≥ 0 , onde g ´ e um disco digital [10]. Analogamente, define-se uma anti-granulometria como sendo o conjunto dos j -fechamentos { φ j g } , onde j ≥ 0 e g ´ e um disco digital [10]. Seja uma imagem f : S → [0 , 1] . A func ¸ ˜ ao V : Z + → R ´ e definida como sendo [10]: V ( k ) = X u ∈ S γ k g ( f )( u ) , (25) 8 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais onde g ´ e a cruz ou o quadrado 3 × 3 . Assim, a func ¸ ˜ ao Ξ : Z + → [0 , 1] ´ e definida da forma que segue: Ξ[ k ] = 1 − V ( k ) V (0) , k ≥ 0 . (26) Considerando a imagem f um conjunto aleat ´ orio e observando que Ξ ´ e uma func ¸ ˜ ao monot ˆ onica, crescente e limitada em [0 , 1] , pois V ( k + 1) < V ( k ) , ∀ k ≥ 0 , podemos afirmar que Ξ ´ e uma func ¸ ˜ ao de distribuic ¸ ˜ ao acumulada discreta associada ` a imagem f [10]. Assim, pode-se definir uma func ¸ ˜ ao densidade discr eta ξ : Z + → R + por meio da diferenc ¸ a: ξ [ k ] = Ξ[ k + 1] − Ξ[ k ] , k ≥ 0 . (27) A func ¸ ˜ ao densidade definida na equac ¸ ˜ ao 27 ´ e denominada espectr o de padr ˜ oes [10]. O espectro de padr ˜ oes, ou espectr o morfol ´ ogico , ´ e uma esp ´ ecie de histogr ama de tamanho e forma , sendo ´ unico para uma imagem espec ´ ıfica f e um determinado elemento estruturante g , desde que f seja bin ´ aria [10]. Uma vez que as transformac ¸ ˜ oes granulom ´ etricas t ˆ em a propriedade de “espalhar” informac ¸ ˜ oes de tamanho e forma nas imagens res ´ ıduo, muitas outras representac ¸ ˜ oes diferentes do histograma de padr ˜ oes dos objetos de interesse podem ser geradas, desde que uma quantidade adequada de transformac ¸ ˜ oes seja utilizada. Como ´ e de se esperar , o n ´ umero de transformac ¸ ˜ oes (ou peneiramentos ) necess ´ ario, ou seja, o maior valor de k , v aria de acordo com a aplicac ¸ ˜ ao, pois est ´ a diretamente associado ` a dimens ˜ ao do vetor de atrib utos a ser utilizado na aplicac ¸ ˜ ao de reconhecimento de padr ˜ oes. 2.6 T riagem virtual A T riagem V irtual consiste em agrupar imagens m ´ edicas semelhantes para facilitar a sua distribuic ¸ ˜ ao para os especialistas respons ´ aveis pela an ´ alise de imagens e, por conseguinte, pelo diagn ´ ostico. Neste trabalho foi estudada uma aplicac ¸ ˜ ao baseada em imagens de imuno-histoqu ´ ımica da placenta e do pulm ˜ ao do tipo CD68 [26, 27]. Essas imagens s ˜ ao utilizadas para se poder auxiliar o patologista no seu diagn ´ ostico fazendo comparac ¸ ˜ ao com outros pacientes e seus respectiv os diagn ´ osticos. Fazendo a comparac ¸ ˜ ao visual ou com o aux ´ ılio de algum programa o patologista pode analisar o caso atual de maneira a reduzir a probabilidade de erro. A busca de imagens em uma base de imagens m ´ edicas pode ser prejudicada por fatores como os que seguem: 1. As imagens foram agrupadas de maneira subjetiv a: influ ˆ encia da subjetividade de cada patologista na an ´ alise pode gerar inconsist ˆ encias no agrupamento; 2. A recuperac ¸ ˜ ao das imagens pode retornar um n ´ umero insuficiente de imagens ou um conjunto de imagens com pouca relev ˆ ancia com o problema; 3. O sistema pode demorar muito para recuperar imagens relev antes: mesmo que o sistema recupere uma quantidade grande de imagens relev antes, a quantidade de tempo gasta com essa recuperac ¸ ˜ ao tamb ´ em ´ e importante para o usu ´ ario. Neste trabalho as imagens s ˜ ao representadas por meio de vetores de atributos constru ´ ıdos usando uma concatenac ¸ ˜ ao dos espectros de padr ˜ oes das bandas R, G e B que comp ˜ oem as imagens coloridas; em seguida s ˜ ao feitos estudos usando PCA para reduc ¸ ˜ ao da dimensionalidade do vetor de atributos, objetiv ando a reduc ¸ ˜ ao do custo computacional na tarefa de classificac ¸ ˜ ao. Assim, a metodologia de busca da soluc ¸ ˜ ao do problema de triagem virtual estudado neste trabalho foi di vidida em cinco etapas: (1) pr ´ e-processamento, (2) segmentac ¸ ˜ ao das imagens, (3) construc ¸ ˜ ao dos espectros de padr ˜ oes, (4) an ´ alise PCA sobre os espectros e (5) uso de SOM-L VQ e MLP para classificar os vetores de caracter ´ ısticas. Essas etapas s ˜ ao ilustradas no esquema da Figura 1. Na ´ ultima fase foram utilizados conjuntos de treino e teste para poder av aliar quantitati v amente a taxa de acertos na triagem das imagens. A segmentac ¸ ˜ ao das imagens R, G e B foi feita com uma implementac ¸ ˜ ao de k-m ´ edias com 4 classes. As imagens utilizadas foram analisadas e na m ´ edia existiam de 3 a 6 classes com o maior n ´ umero de pixels . Dentre essas classes, apenas 4 seriam suficientes para representar as imagens. Com isso, foram escolhidas 3 classes para representar os objetos presentes na imagem, enquanto uma quarta classe representa fundo da imagem. Ao fim da segmentac ¸ ˜ ao a quarta classe ´ e removida, restando apenas tr ˆ es classes. Foram calculados os espectros de padr ˜ oes para as imagens R, G e B usando 25 iterac ¸ ˜ oes para compor cada espectro, ficando assim cada banda espectral com um espectro de 25 atrib utos. Em seguida esses espectros foram concatenados em um v etor ´ unico, obtendo-se ao fim um vetor de 75 dimens ˜ oes. A an ´ alise PCA foi o passo que tev e como entrada a matriz unificada gerada, que representav a as imagens dos dois tipos. Essa matriz foi processada para obter a menor representac ¸ ˜ ao, i.e. com a menor quantidade de atributos, mas mantendo uma boa representac ¸ ˜ ao dos dados. Foi usada uma rede SOM-L VQ e uma rede MLP para classificar os dados usando a validac ¸ ˜ ao cruzada como condic ¸ ˜ ao de parada da rede. As duas redes foram testadas usando a matriz resultante da an ´ alise PCA e a matriz sem o uso da an ´ alise PCA. A classificac ¸ ˜ ao foi dividida em duas etapas, como descrito adiante. Primeiro foi feita uma an ´ alise para se descobrir a melhor configurac ¸ ˜ ao de rede para o problema. Para isso foi estabelecida uma bateria de testes que fez os treinamentos da rede variando a quantidade de neur ˆ onios na camada escondida. Foram utilizados de 10 a 30 neur ˆ onios com 20 repetic ¸ ˜ oes para cada rede. Em cada passo foi guardada a melhor rede, baseando-se na taxa de 9 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais Figura 1: Metodologia empregada: etapas da classificac ¸ ˜ ao para triagem virtual 10 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais (a) (b) (c) (d) Figura 2: T ipos de imagens de imuno-histoqu ´ ımica CD68: (a) NP com mais zoom ; (b) NP com menos zoom ; (c) P com mais zoom ; e (d) P com menos zoom . acertos e na m ´ edia de acertos de todas as redes. O segundo passo foi repetir os testes com a melhor rede e obter a m ´ edia, desvio padr ˜ ao e mediana da taxa de acertos. A matriz de entrada foi dividida em 19% para teste e 81% para treino e os valores foram embaralhados no in ´ ıcio dos treinos. Com isso, o resultado obtido foi uma comparac ¸ ˜ ao da abordagem usando o PCA, para reduzir a complexidade, mas com o intuito de manter uma boa representac ¸ ˜ ao das imagens com uma abordagem de refer ˆ encia usando todos os par ˆ ametros do vetor de entrada. Neste trabalho foram utilizadas imagens de imuno-histoqu ´ ımica CD68 da placenta e do pulm ˜ ao [26, 27]. As imagens foram diferenciadas pela nomenclatura P (pulm ˜ ao) e NP (placenta). As imagens foram adquiridas usando dois tipos de zoom . A Figura 2 ilustra quatro de todas as imagens utilizadas. A base de dados tem um total de 113 imagens, sendo 53 imagens do tipo NP e 60 imagens do tipo P . 3 Resultados Experimentais As imagens na aplicac ¸ ˜ ao de CBIR de T riagem V irtual foram representadas usando vetores multidimensionais baseados nos seguintes passos, e com os resultados que se guem: 1. Cada imagem foi separada em bandas R, G e B; 2. Cada banda foi segmentada, resultando uma imagem com quatro clusters, sendo o maior retirado; 3. Foi constru ´ ıdo o espectro de padr ˜ oes da cada banda resultando em um vetor de 25 dimens ˜ oes. Depois de serem unificados, resultaram em um vetor de 75 dimens ˜ oes. As classes de imagens NP e P ficaram com matrizes 53 por 75 e 60 por 75, respectiv amente. Por fim, foi gerada a matriz de caracter ´ ısticas para representar a base de dimens ˜ ao 113 por 75 pela uni ˜ ao dessas duas matrizes; 4. A an ´ alise PCA reduziu a complexidade da base para uma matriz 113 por 50. Obtev e-se assim uma reduc ¸ ˜ ao de 33,33% na quantidade de atributos da matriz. Ou seja, uma reduc ¸ ˜ ao de cerca de 1/3. Os testes de agrupamento das imagens foram feitos em duas etapas. Para implementar o m ´ etodo proposto para triagem virtual foi usado o ambiente Matlab na vers ˜ ao R2007b como plataforma para construc ¸ ˜ ao, teste e treinamento da metodologia proposta. 11 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais Foram utilizados 22 padr ˜ oes para teste e 91 padr ˜ oes para treinamento. Desses v alores de teste, 11 eram do tipo NP e 11 eram do tipo P . Dos 91 padr ˜ oes para treinamento, 42 eram do tipo NP e 49 eram do tipo P . T odos os treinamentos usaram validac ¸ ˜ ao cruzada com parte dos dados de treinamento. Ap ´ os a primeira etapa de classificac ¸ ˜ ao foram geradas estat ´ ısticas para embasar a selec ¸ ˜ ao da melhor rede. Os resultados s ˜ ao mostrados na T abela 2, com a rede utilizada, a quantidade de atributos que foram usados como entrada da rede ( m ), a taxa de acerto da melhor rede ( η OTM ), a m ´ edia ( ¯ η ), o desvio padr ˜ ao ( ∆ η ), a mediana ( η MED ) e a quantidade de neur ˆ onios da melhor rede ( n OTM ). T abela 2: Resultados da primeira etapa da classificac ¸ ˜ ao, usando PCA ( m = 50 ) e sem uso do PCA ( m = 75 ) Rede m η OTM (%) ¯ η ± ∆ η (%) η MED (%) n OTM MLP 50 95,23 57,05 ± 0,48 68,18 22 75 90,47 53,83 ± 0,47 50,00 19 SOM L VQ 50 66,66 50,49 ± 0,23 40,91 10 75 80,95 47,14 ± 0,15 50,00 17 Nas T abelas 2 e 3 s ˜ ao apresentados os resultados para MLP e SOM-L VQ, considerando quantidades de atributos 50 e 75, com e sem o uso de PCA, respectiv amente. Para as redes MLP usando padr ˜ oes obtidos com o uso de PCA ( m = 50 ) foi observada uma m ´ edia de acertos de 57,05% e um desvio padr ˜ ao de 0,48%; no entanto, foi observada uma mediana distante da m ´ edia (mediana de 68,18%), indicando que houve resultados d ´ ıspares em relac ¸ ˜ ao ` a m ´ edia. Isso fica e vidente quando se observ a a taxa de acerto da melhor rede, de 95,23%. Neste caso, a rede com 22 neur ˆ onios na camada escondida foi escolhida como a melhor rede, baseando-se na sua alta taxa de acertos. No caso das redes MLP sem usar padr ˜ oes obtidos com PCA ( m = 75 ) foi observada uma m ´ edia de acertos de 53,83% e um desvio padr ˜ ao de 0,47%; por ´ em n ˜ ao foi observ ada uma mediana t ˜ ao distante da m ´ edia (mediana de 50,00%), indicando que os resultados estav am mais sim ´ etricos. Neste caso, a rede com 19 neur ˆ onios na camada escondida foi escolhida como a melhor rede, baseando-se na sua alta taxa de acertos de 90,47%. Para as redes SOM-L VQ com o uso de PCA ( m = 50 ) foi observada uma reduc ¸ ˜ ao na m ´ edia de acertos das redes em comparac ¸ ˜ ao com as redes MLP . Com uma m ´ edia de acertos de 50,49% e um desvio padr ˜ ao de 0,23%. Como nas redes anteriores, foi observada uma mediana distante da m ´ edia (mediana de 40,91%), indicando que houv e resultados d ´ ıspares em relac ¸ ˜ ao ` a m ´ edia. Contudo, o baixo valor do desvio padr ˜ ao indica que os v alores das taxas de acertos para as redes n ˜ ao oscilaram muito em relac ¸ ˜ ao ` a m ´ edia. Assim, a rede com 10 neur ˆ onios na camada escondida foi escolhida como a melhor rede, com uma taxa de acerto de 66,66%. Para as redes SOM-L VQ, sem usar padr ˜ oes obtidos com PCA ( m = 75 ), observou-se tamb ´ em uma reduc ¸ ˜ ao da efetividade de acertos da rede em comparac ¸ ˜ ao com as redes MLP , com uma m ´ edia de acertos de 47,14% e um desvio padr ˜ ao de 0,15, com uma mediana n ˜ ao muito distante da m ´ edia (mediana de 50,00%) indicando que n ˜ ao houv e resultados d ´ ıspares em relac ¸ ˜ ao ` a m ´ edia, embora possa ser notado com clareza que a taxa de acerto da melhor rede foi bastante alta: 81%. Neste caso, a rede com 17 neur ˆ onios na camada escondida foi escolhida como a melhor rede, baseando-se na sua alta taxa de acertos. Depois de selecionar as melhores redes, na segunda etapa foram obtidos os resultados da T abela 3. T abela 3: Resultados da segunda etapa da classificac ¸ ˜ ao, usando PCA ( m = 50 ) e sem uso do PCA ( m = 75 ) Rede m ¯ η ± ∆ η (%) η MED (%) η OTM (%) MLP 50 60,95 ± 0,47 70,45 80,95 75 55,71 ± 0,49 68,18 80,95 SOM L VQ 50 52,85 ± 0,21 36,36 61,90 75 49,76 ± 0,15 45,45 71,42 Para as redes MLP usando padr ˜ oes obtidos com PCA ( m = 50 ), foi observada uma m ´ edia de acertos de 60,95%, um desvio padr ˜ ao de 0,47%, e uma mediana de 70,45%, indicando uma certa dist ˆ ancia entre as taxas de acertos das redes. Isso fica mais claro quando se observ a a taxa de acerto da melhor rede, de 80,95%. No caso das redes MLP sem usar padr ˜ oes obtidos com PCA ( m = 75 ), obteve-se uma m ´ edia de acertos de 55,71%, desvio padr ˜ ao de 0,49% e mediana de 68,18%. A melhor rede teve uma taxa de acerto de 80,95%. Foi obtido, assim, um resultado parcialmente similar ` aquele obtido para as redes com PCA, por ´ em com uma m ´ edia de acertos inferior . Para as redes com SOM-L VQ usando padr ˜ oes com PCA ( m = 50 ), no v amente foi observada uma reduc ¸ ˜ ao na m ´ edia de acertos das redes em comparac ¸ ˜ ao com as redes MLP . Observ ou-se uma taxa de acertos de 52,85%, um desvio padr ˜ ao de 0,21%, e uma mediana de 36,36%. O baixo desvio padr ˜ ao e o v alor da mediana sugerem uma razo ´ avel assimetria entre os dados. Contudo a taxa de acerto da melhor rede n ˜ ao ficou t ˜ ao distante da m ´ edia: 61,90%. No caso das redes SOM-L VQ sem usar padr ˜ oes obtidos com PCA ( m = 75 ), obteve-se uma m ´ edia de acertos de 49,76%, uma m ´ edia de 0,15%, e mediana de 45,45%. Por ´ em, mesmo com o valor relati v amente baixo de desvio padr ˜ ao e a proximidade entre mediana e m ´ edia, obtev e-se uma melhor rede com uma taxa de acerto de 71,42%, ficando acima da melhor rede SOM-L VQ com PCA. 4 Discuss ˜ ao e Conclus ˜ oes O uso de redes MLP no m ´ etodo de triagem virtual proposto neste trabalho resultou numa taxa de acerto de 81%, o que pode ser considerado razo ´ avel, uma vez que a triagem virtual desempenha o papel de pr ´ e-classificac ¸ ˜ ao. Contudo, para validar a proposta, seria necess ´ ario realizar uma triagem usando especialistas humanos, especificamente patologistas. Este trabalho busca 12 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais na v erdade ser uma prov a de conceito, mostrando que ´ e poss ´ ıvel aplicar a ideia de CBIR para desenv olver um sistema de triagem virtual para otimizar o trabalho de an ´ alise de imagens realizado por especialistas humanos, usando o espectro de padr ˜ oes para representar as imagens, sendo este o maior diferencial deste trabalho em relac ¸ ˜ ao a outras aplicac ¸ ˜ oes de CBIR. Os resultados obtidos indicam que o uso de PCA para reduzir a quantidade de atributos suficiente para representar os dados reduziu o custo computacional, dado que reduziu a dimensionalidade, e aumentou a taxa de acerto da classificac ¸ ˜ ao. Nas redes MLP houve uma melhora de aproximadamente 9% da taxa de acerto com o uso de PCA. J ´ a nas redes SOM-L VQ houve uma melhora de 6% em relac ¸ ˜ ao ` a taxa de acertos com o uso de PCA. As redes MLP se mostraram mais adequadas ao problema, com alta taxa de acerto nas melhores redes: 81%. As redes SOM-L VQ obti veram resultados n ˜ ao t ˜ ao razo ´ aveis nas suas classificac ¸ ˜ oes. As redes obtiv eram uma melhor rede com uma taxa de 71,4% sem usar PCA superior a melhor rede com o uso de PCA, indicando que, nesse caso, as redes SOM-L VQ necessitam de mais informac ¸ ˜ oes para poder ter uma melhor generalizac ¸ ˜ ao e por conseguinte se adequar ao problema em quest ˜ ao. A comparac ¸ ˜ ao dos resultados da triagem usando MLP e SOM mostrou que as redes MLP se adequaram melhor ao problema, com uma maior taxa de acerto. Uma das dificuldades encontradas foi o alto custo computacional aparente necess ´ ario para obtenc ¸ ˜ ao dos espectros de padr ˜ oes das imagens, j ´ a que era calculado o espectro para cada banda de uma imagem e isso era repetido para toda a base. Depois de gerado os vetores, o treinamento para se obter as melhores redes exigia um tempo de processamento tamb ´ em razo ´ avel. Como trabalho futuro podem ser in vestigadas arquiteturas paralelas para otimizac ¸ ˜ ao do tempo dispendido no c ´ alculo dos espectros de padr ˜ oes, buscando paralelizar ao m ´ aximo a ex ecuc ¸ ˜ ao das granulometrias. Refer ˆ encias [1] G. Gagaudakis and P . L. Rosin. “Shape measures for image retriev al”. P attern Recognition Letters , vol. 24, no. 15, pp. 2711–2721, 2003. [2] G. Gagaudakis and P . L. Rosin. “Incorporating shape into histograms for CBIR”. P attern Recognition , vol. 35, no. 1, pp. 81–91, 2002. [3] C. A. B. Casta ˜ n ´ on. “Recuperac ¸ ˜ ao de imagens por conte ´ udo atrav ´ es de an ´ alise multiresoluc ¸ ˜ ao de W avelets”. Master’ s thesis, Instituto de Ci ˆ encias Matem ´ aticas e de Computac ¸ ˜ ao da Univ ersidade de S ˜ ao Paulo, S ˜ ao Paulo, Brasil, 2003. [4] T . S. H. Y . Rui and S. F . Chang. “Image Retrie val: Current T echniques, Promising Directions, and Open Issues”. Journal of V isual Communication and Imag e Repr esentation , vol. 10, no. 1, pp. 39–62, 1999. [5] A. Zhang, R. S. A yg ¨ un and Y . Song. “Feature-based retriev al in visual database systems”. In Multimedia Information Retrieval and Manag ement: T echnological Fundamentals and Applications , edited by D. Feng, W . C. Siu and H. J. Zhang, New Y ork, 2003. Springer-V erlag. [6] H. K. Huang. “P ACS, image management and imaging informatics”. In Multimedia Information Retrieval and Manag e- ment: T echnological Fundamentals and Applications , edited by D. Feng, W . C. Siu and H. J. Zhang, New Y ork, 2003. Springer-V erlag. [7] T . W . Cai, D. D. Feng and R. Fulton. “Content-based retriev al for medical data”. In Multimedia Information Retrieval and Management: T echnological Fundamentals and Applications , edited by D. Feng, W . C. Siu and H. J. Zhang, New Y ork, 2003. Springer-V erlag. [8] F . Long, H. Zhang and D. D. Feng. “Fundamentals of content-based image retriev al”. In Multimedia Information Retrieval and Management: T echnological Fundamentals and Applications , edited by D. Feng, W . C. Siu and H. J. Zhang, New Y ork, 2003. Springer-V erlag. [9] J. S. jin. “Indexing and retrieving high dimensional visual features”. In Multimedia Information Retrieval and Management: T echnological Fundamentals and Applications , edited by D. Feng, W . C. Siu and H. J. Zhang, New Y ork, 2003. Springer- V erlag. [10] U. M. Braga Neto. “Reconstruc ¸ ˜ ao V olum ´ etrica e An ´ alise de Imagens T ridimensionais por Morfologia Matem ´ atica”. Mas- ter’ s thesis, Faculdade de Engenharia El ´ etrica da Univ ersidade Estadual de Campinas, Campinas, Brasil, 1994. [11] A. Antani, L. R. Long, G. R. Thoma and R. J. Stanley. “V ertebra shape classification using MLP for content-based image retriev al”. In Proceedings of the International J oint Conference on Neur al Networks , pp. 160–165. IEEE, 2003. [12] K. K. Seo. “An application of one-class support vector machines in content-based image retriev al”. Expert Systems with Applications , vol. 33, no. 2, pp. 491–498, 2007. [13] Z. L. K ov ´ acs. Redes Neurais Artificiais: Fundamentos e Aplicac ¸ ˜ oes . Acad ˆ emica S ˜ ao Paulo, S ˜ ao Paulo, 1996. [14] A. P . Braga, A. C. P . L. F . Carvalho and T . B. Ludermir. Redes Neurais Artificiais: T eoria e Aplicac ¸ ˜ oes . L TC, S ˜ ao P aulo, 2000. 13 Learning and Nonlinear Models - Revista da Sociedade Brasileira de Redes Neurais (SBRN), V ol. XX, No. XX, pp. XX-XX, 2010 c Sociedade Brasileira de Redes Neurais [15] J. Sklansky and G. N. W assel. P attern Classifiers and T rainable Mac hines . Springer-V erlag, first edition, 1981. [16] S. Arik. “ An Analysis of Exponential Stability of Delayed Neural Networks with Time V arying Delays”. Neural Networks , , no. 17, pp. 1027–1031, 2004. [17] F . M. Ham and I. Kostanic. Principles of Neurocomputing for Science and Engineering . McGraw-Hill, 2001. [18] F . A. Sala, F . M. Azev edo and F . I. M. Argoud. “Mapas de Kohonen na detecc ¸ ˜ ao de eventos epileptog ˆ enicos”. In III Congr esso Latino-Americano de Engenharia Biom ´ edica , pp. 533–536, Jo ˜ ao Pessoa, Brasil, 2004. Sociedade Brasileira de Engenharia Biom ´ edica. [19] S. Haykin. Redes Neurais: Princ ´ ıpios e Pr ´ atica . Bookman, Porto Alegre, 2001. [20] A. L. B. Candeias. “ Aplicac ¸ ˜ ao da Morfologia Matem ´ atica ` a An ´ alise de Imagens de Sensoriamento Remoto”. Ph.D. thesis, Departamento de Computac ¸ ˜ ao Aplicada do Instituto Nacional de Pesquisas Espaciais, S ˜ ao Jos ´ e dos Campos, Brasil, 1997. [21] D. Landgrebe. “Hyperspectral Image Analysis”. IEEE Signal Pr ocessing Magazine , Jan 2002. [22] R. Klette and P . Zamperoni. Handbook of Image Pr ocesing Operator s . John Wile y & Sons, first edition, 1995. [23] E. R. Dougherty and C. R. Giardina. Matrix Structur ed Image Pr ocessing . Prentice Hall, 1987. [24] G. J. F . Banon and J. Barrera. Bases da Morfologia Matem ´ atica para An ´ alise de Imagens Bin ´ arias . UFPE-DI, 1994. [25] P . Soille. Morphological Imag e Analysis: Principles and Applications . Springer-V erlag, New Y ork, 2004. [26] W . P . Santos. “ An ´ alise de Imagens Digitais em Patologia utilizando Morfologia Matem ´ atica e L ´ ogica Nebulosa”. Master’ s thesis, Programa de P ´ os-Graduac ¸ ˜ ao em Engenharia El ´ etrica da Univ ersidade Federal de Pernambuco, Recife, Brasil, 2003. [27] W . P . Santos, A. L. B. Candeias, A. F . S. Bezerra and A. F . D. Silva. “ Aux ´ ılio ao Diagn ´ ostico da Doenc ¸ a da Membrana Hi- alina utilizando An ´ alise de Imagens por L ´ ogica Nebulosa”. In III Congr esso Latino-Americano de Engenharia Biom ´ edica , pp. 1243–1246, Jo ˜ ao Pessoa, Brasil, 2004. Sociedade Brasileira de Engenharia Biom ´ edica. 14

Original Paper

Loading high-quality paper...

Comments & Academic Discussion

Loading comments...

Leave a Comment