Self-Organizing Mixture Networks for Representation of Grayscale Digital Images

Self-Organizing Maps are commonly used for unsupervised learning purposes. This paper is dedicated to the certain modification of SOM called SOMN (Self-Organizing Mixture Networks) used as a mechanism for representing grayscale digital images. Any gr…

Authors: Patryk Filipiak

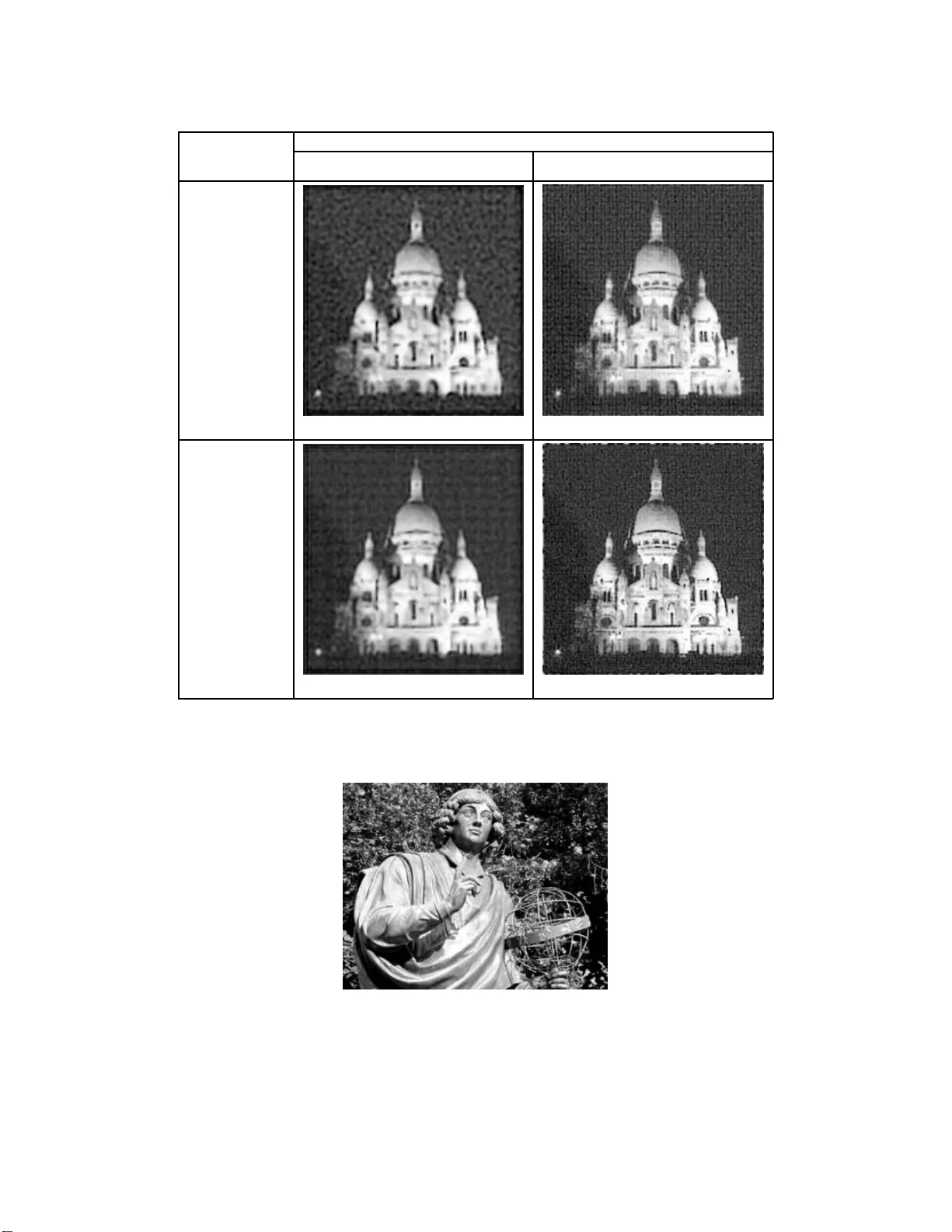

Samo organizują ce się sieci mi eszank o w e w reprezen tacji fo togr afii cyfro wyc h w sk ali sza rości P atryk Filipiak Inst ytu t Informatyki, Uniw e rsytet W ro cła wski patryk.filipiak@ii.un i.wro c.pl 4 września 2018 Streszczenie Sieci Ko honena (SOM) są na jczęściej wykorzyst yw an ym narzę dziem w celu tzw. uczenia bez nadzoru. Dlatego też doczeka ły się wiel u mo dyfik acji i adaptacj i. Niniejsza praca p oświę cona jest samoorganizu- jącym się sieciom mieszank o wym (SO MN), będącym istotnym rozwinięciem pierw otnej idei Kohonena. Zdolność SOMN do efekt ywnego uczenia się d ow olnego rozkładu stat ystycznego uk azana została na przy- kładzie foto grafii cyfrowyc h w sk al i szarości. Dow ol ny obraz cyfro wy w sk ali szarości może być przyb liżon y za p omocą skończonej mies zanki gausso wskiej, której parametry dobierane są automat ycznie w procesie uczenia SOMN. W niniejszej publik acj i przedstaw iona została grupa przyk ł adó w takiego wykorzystania SOMN przy użyciu zai mplemento w anej w t ym celu aplik acji. 1 W stęp Reprezetacja w sk ali szar o ści obr azu o rozdzielczo ści M × N pikseli sprowadza się do przypisania k ażdem u z M · N punktów wartości natężenia jego jasno ści. Wielk ość tę zwycza jow o p odda jemy dyskretyzacji do wartości ca łk owit yc h z prze dzia łu o d 0 do 255, co umożliwia przecho wanie jej w dokła dnie jedn ym ba jcie pamięci komput era. Określamy funkcj ę jasności l : { 0 , . . . , M − 1 } × { 0 , . . . , N − 1 } − → { 0 , . . . , 255 } , k tóra k ażdem u pikselowi obrazu ( x, y ) ∈ { 0 , . . . , M − 1 } × { 0 , . . . , N − 1 } przy p orz ą dk owuje dyskr etną wartość natężenia j ego jasnośc i. Niec h: L = M − 1 X x =0 N − 1 X y =0 l ( x, y ) . Wów czas funk cja l ′ = l L jest dyskretyzacją funk cji gęstoś ci pewneg o ro zkładu wektora losow ego w prze - strzeni dwu wymiarow ej. Możemy zatem postrz e g ać obraz w kryteriach r o zkładu stat yst ycznego. Niec h x b ędzie wektorem losowym w przestrzeni d -wymia row ej Ω ⊆ R d ( d > 1 ). Mówimy , że wektor losowy x ma rozkład w p o staci s k ońc zonej mieszanki (ang. finite mixtur e distribution ), jeżeli funkcja gęstości jego rozkładu jest następująca: p ( x ) = p 1 ( x ) P 1 + . . . + p K ( x ) P K ( x ∈ Ω , K > 1 ) , (1) gdzie P i > 0 , i = 1 , . . . , K ; K X i =1 P i = 1 oraz p i ( · ) > 0 , i = 1 , . . . , K ; Z Ω p i ( x ) d x = 1 . 1 Zmienne P 1 , . . . , P K nazywać b ędziemy w agami , z a ś funk cje p 1 ( · ) , . . . , p K ( · ) — składnik ami m ieszanki . Dla mieszanek jednor odnyc h (tzn. takich, których składniki są funkcjami gęstości tego samego typu) wygo dnie będzie za pisać Ró wnanie 1 w pos taci p ( x | Θ) = K X i =1 p i ( x | θ i ) P i , (2) gdzie θ i są wektorami parametrów i -tego rozkładu, zaś Θ = ( θ 1 , . . . , θ K ) . W niniejszej pracy rozważać będziemy miesza nki gaussowskie z a dane wzorem ∀ i =1 ,...,K p i ( x | θ i ) = 1 (2 π ) d 2 · | Σ i | 1 2 · exp − 1 2 ( x − m i ) T Σ − 1 i ( x − m i ) , (3) gdzie θ i = { θ i 1 , θ i 2 } = { m i , Σ i } to (kolejno) wektor wartości średnich ora z ma cierz ko w ariancji rozkła du normalnego . 2 Klasteryzacja za p omo cą sieci K ohonena (SOM) Niec h d > 1 oraz { x ; x = ( x 1 , . . . , x d ) ∈ Ω ⊆ R d } b ędzie próbk ą z pewnego rozkładu prawdopo dobień- stw a (cią głeg o lub dyskretneg o), zaś { m } = { m i ∈ R d ; i = 1 , . . . , K } usta lon ym zbior em tzw. wektor ów kotwic owych . T eselacją V oronoi’a [1] przestrz e ni Ω ⊆ R d nazywam y pro cedurę jej po działu na K wypukłych p o d- zbiorów V i ( { m } ) wyznaczonych przez wektory m i ∈ R d następująco: ∀ i =1 ,...,K V i ( { m } ) = { x ∈ Ω ; ∀ j 6 = i k x − m i k < k x − m j k} , (4) gdzie k · k oznacza normę euklidesow ą. Uzys k any po dział nazywam y mozai ką V or onoi ’a . Zauw ażm y , jakie znaczenie o dgrywa o dp owiedni do b ór wektorów kotwico wyc h. Aby wynikow a moza ik a V oronoi’a była reprez e ntat ywna dla wy jścio wego ro zkładu p ( x ) i użyteczna dla po tr zeb klas teryzacji, m usimy zadbać o to, by gęstość roz mies zczenia wektorów m i b yła pro por cjonalna do gęstoś ci p ( x ) w dan ym regio nie. Inn ymi słowy — chcem y , ab y: ∀ i 6 = j P ( x ∈ V i ( { m } )) = P ( x ∈ V j ( { m } )) . Sieci K ohonena (SOM, od ang. Self-organizing Ma ps [3, 4]) rea lizują koncepcję tzw. samo or ganizacji top olo gicznej . Nacisk kładzio n y jest bowiem nie tylk o na roz mies zczenie wektorów kot wicowyc h m i ∈ R d traktow an ych niezależnie, ale również ich wza jemne p ołożenie. Niec h G b ędzie dow olnym gra fem spó jnym, którego wierzchołk ami są wszystkie K wektory kot wico w e m i . Niec h p onadto d ( i , j ) b ędzie p ewną gra fową miarą odległo ści w G . Okr e ś lm y funk cję e h : R + ∪ { 0 } − → [0 , 1] o własnościa ch: (a) e h jest ściśle malejąca , (b) e h (0) = 1 , (c) lim z →∞ e h ( z ) = 0 . Dla tak zadanego o dwzor ow ania e h zdefiniujm y funkcję sąsie dztwa (ang. neighb ourho o d function ) h : { ( i, j ) ; i, j = 1 , . . . , K , i 6 = j } − → R na stępująco: ∀ i 6 = j h ( i, j ) = e h d ( i, j ) σ , (5) gdzie σ > 0 jest p ewn ym parametr e m a lgorytmu. W k aż dej iteracji wektor x leżący w i - tej k omórce V oronoi’a po rusza wszystkie j -te wektory k ot wicow e, dla któr y c h d ( i, j ) < σ . 2 x 1 x 2 m i Rysunek 1: Przykładow a mo z a ik a V orono i’a dla d = 2 . Rysunek zaczerpnięto z [1]. 2.1 Algorytm SOM • Dane: Liczba K ∈ N , skończony zbiór wektorów los o wych x ∈ Ω ⊆ R d zgo dn y z rozkła dem pr a wdop o- dobieństw a p ( x ) , funk cja sąsiedztw a h ( i, j ) oraz parametry σ , η . • Wynik: Zbió r wektorów kotwico wyc h { m } = { m i ∈ R d ; i = 1 , . . . , K } tw orzących strukturę gra fu, reprezentat ywn y dla p ( x ) . W ybierz losow o wszystkie wektory m i ∈ R d , a następnie p owtarza j: 1. W ylosuj w ektor x ∈ Ω zg odnie z rozk ładem p ( x ) . 2. Zna jdź k omórkę V oronoi’a zawiera jącą x , to znaczy wyznacz indeks i taki, że: ∀ j 6 = i k x − m i k < k x − m j k . 3. Przesuń wszystkie w ektory kot wico w e m j w stronę x według następującej form uły: m j ← m j + η ( x − m j ) h ( i, j ) . (6) 3 Samo o rganizujące się sieci mieszank o w e Samo or ganizując e się sie ci mieszankowe (ang. Self-Or ganizi ng Mixtur e Networks , w skró cie S OMN ) [6] są uogólnieniem po jęcia Bayesi an Self-Or ga nizing Maps ( BSOM ) [5]. Cechu je je dwuw artstw o w a struktur a , po zw ala jąca p ołącz yć zale ty sieci K ohonena (SOM) z mo żliw ością uczenia ma c ie r zy ko w ariancji or az w ag dla k aż dej ze składowyc h mieszanki. 3.1 Arc hitektura sieci Na Rysunku 2 przedstawiono schemat ycznie dwuw arstw o w ą strukturę s ieci. Niższa warst w a funkcjon uje na zasadach bar dzo zbliżonyc h do sieci Kohonena. W yższa natom ia st p owsta je p oprzez sumow anie wszys tkic h węzłó w z uwzględnieniem wag P i , z jakimi węzły te występują w wyniko wej miesza nce (p or. Równanie 2), da jąc w wyniku w artość p ( x | Θ) dla dow olnego x ∈ Ω . 3 p ( x | Θ) Σ P i w Rysunek 2: Schemat yczne przedsta wienie SO MN zaczerpnięte z [6]. W praktyczn ym zas tosow aniu SOMN do repr ezen tacji o brazów cyfrowyc h, przekształcenie funkcji gęstości rozkładu na wartość jasno ś ci k ażdego kolejnego piksela jest niewystarcza jąc e. Ignoruje ono b owiem informację o ś r edniej jasności całego obrazu, traktując jednako w o obrazy utrzyma ne w jasnyc h jak i ciemn ych odcienia c h, o dwzorowując jedynie kon trast pomiędzy na jjaśniejszym i na jciemniejszym pikselem. Prow adzić t o może do błędnej reprezentacji wy jściowego obra zu ( po r. Rysunek 3). Celem uniknięcia p owyższego błędu, na leż y dla wejścio w ego obr a zu o r ozdzielczości M × N wyznaczyć sumę jasnoś ci ws zystkic h M · N pikseli. Pamięta jąc o wsp o mnianej wcześniej kwestii r o zbieżności w repre- zent acji o dcieni, tzn. l ( · , · ) = 0 oznacz a o dcień na jciemniejszy , zaś gęstość p ( ·|· ) = 0 — o dcień na jjaśniejszy — obliczymy w isto cie sumę ró ż nic p ostaci: L ′ = M − 1 X x =0 N − 1 X y =0 (255 − l ( x, y )) . 3.2 Uczenie SOMN Uczenie SOMN jest pro cesem iteracyjnym. W ch wili inicjaliza cji sieć skła da się z e K węzłów, gdzie e K > K . Jeżeli w artość K jest znana a priori , przyjm ujem y z w y kle e K = K . W przeciwnym ra zie szac ujemy ją z góry , aby uniknąć błędu wynik a jącego ze zb yt niewielkiej liczb y składnikó w mieszanki, co w o czywisty sp osób obniżałoby dokła dność przybliżenia rozkładu. W k ażdym z T ∈ N k rokó w uczenia sieci losujemy pr óbk ę x ( t ) zgo dnie z przybliża n ym rozk ładem p ( x ) , w k onsekwencji czeg o niez na cznie modyfikujemy jej stan. Aktualną po stać mieszanki oznaczmy jako: ˆ p ( x | ˆ Θ) = e K X i =1 ˆ p i ( x | ˆ θ i ) ˆ P i , (7) gdzie ˆ Θ = ( ˆ θ 1 , . . . , ˆ θ e K ) . 4 (a) (b) (c) Rysunek 3 : O dwzorow anie jasności o brazu: (a) o braz wyjściowy , (b) i (c) pr zykłady niep oprawnego o dwzo- row ania. Niec h t = 1 , . . . , T b ędzie n umerem bieżącej iteracji. W ektorowi x ( t ) przyp orządkowuj em y węzeł, dla którego w artość prawdopo dobieństw a warunko w ego ( a p o steriori ) oblicza nego w edług form uły: ˆ P ( i | x ) = ˆ P i ˆ p i ( x | ˆ θ i ) ˆ p ( x | ˆ Θ) (8) jest na jwiększ a . Węzeł taki zw y cza jowo nazywamy zwycięzc ą (ang. winner ). Na Ry s unku 2 prze ds ta wiony jest jako na jwiększe niewyp ełnione koło oznaczo ne literą w . P ozostałe niewype łnione koła symbolizują węzły zna jdujące się w bezp ośre dnim sąs iedztwie zwycięzcy . 3.3 Algorytm SOMN • Dane: Liczba e K ∈ N , sk ończony zbiór wektorów losowych x ∈ Ω ⊆ R d zgo dn y z rozkła dem pr a wdop o- dobieństw a p ( x ) , o dleg łość g rafow a d ( i, j ) , ciąg nierosnąc y ( a t ) ∞ t =1 zbieżny do zera oraz skończony cią g niemalejący ( δ t ) T t =1 o tej własności, że δ T = 0 . • Wynik: Graf w ęzłów sieci (z parametrami ˆ P i , ˆ θ i , gdzie ˆ θ i = { ˆ m i , ˆ Σ i } dla i = 1 , . . . , e K ) repr ezen tat ywny dla p ( x ) . Zainicjuj do wolną meto dą wszy s tkie pa rametry ˆ P i , ˆ θ i , a następnie dla t = 1 , . . . , T powtarza j: 1. W ylosuj w ektor x ∈ Ω zg odnie z rozk ładem p ( x ) . 2. Zna jdź indeks i ∈ { 1 , . . . , e K } węzła, dla którego w artość: ˆ P ( i | x ) = ˆ P i ˆ p i ( x | ˆ θ i ) ˆ p ( x | ˆ Θ) jest na jwiększa. 3. Dla wszystkich węzłów j ∈ { 1 , . . . , e K } takich, że d ( i, j ) 6 δ ( t ) przypisz: ˆ m j ← ˆ m j + a ( t ) ˆ P ( j | x ) [ x − ˆ m j ] , ˆ Σ j ← ˆ Σ j + a ( t ) ˆ P ( j | x ) n [ x − ˆ m j ] [ x − ˆ m j ] T − ˆ Σ j o , ˆ P j ← ˆ P j + a ( t ) h ˆ P ( j | x ) − ˆ P j i . 5 4. Dla wszystkich węzłów j = 1 , . . . , e K wykona j normalizację: ˆ P j ( t ) ← ˆ P j ( t ) P e K k =1 ˆ P k ( t ) . 4 Przykłady T est y zostały wykonane przy wykorzystaniu progr a m u (stanowiącego integralną cześć pra cy [2]) implement u- jącego opisany w ariant algorytmu SOMN. Progr a m ten dostarcza możliwość skonfigurow ania następujących parametrów uczenia sieci: Suw ak L e arn pozwala wybrać wartość z przedziału 0 , 01 ÷ 1 , 00 z dokładnoś cią 0 , 0 1 . W yrazy cią gu wsp ółczynników sterujących temp em uczenia dla wektorów średnich ˆ m i oraz mac ierzy ko w ariancji ˆ Σ i określone są wzorem: a ( t ) = C ool ing f actor ( t ) · Le a rn . Dla zniwelo w ania efektu zbyt gwałto w- n ych wahań wag w ęzłów SO MN w pro cesie uczenia, wprow adzono do datko wy para metr W eight z przedziału 0 , 0 0001 ÷ 0 , 00100 określany z dokła dnością 0 , 00001 . Cią g wsp ółczynnikó w determinującyc h tempo uczenia wag węzłów wyra żon y jest więc wzorem: α ( t ) = a ( t ) · W eig ht . W pierwszej kolejności p osłużymy się fotografią gmach u węgierskieg o parlamentu w B udapeszcie: Rysunek 4: Obra z wejściowy w s k ali szaro ści ( 64 0 × 480 pikseli). Zdjęcie prze sycone jest deta lami architektonicznymi, dlatego jego p oprawne o dwzorow anie wymaga pre- cyzyjnego dobrania pa rametrów. Rysunek 5(a) p ok azuje, że 100 tysięcy iteracji to zdecydow anie zb yt mało, b y o ddać szczegóły budo wli. Obraz jest mocno roz m yt y i nieczyteln y . Z kolei Rysunek 5(b) przedstawia wy- nik działania SOMN p o pięciu milionac h iteracji z par ametrami: Lear n = 0 , 15 or az W eig ht = 0 , 000 05 , które w przypa dku tego obrazu ok aza ły się b yć zbyt wysokie. Zw ażywszy , że uzysk anie wyniku w niniejszym przypadku p o chłonęło nieco p onad 7 go dzin, widzimy , że właściwe dobranie para metró w sta je się pr oces em czaso chłonn ym. 6 (a) (b) Rysunek 5: Sieć rozmiar u 1 00 × 1 00 w ęzłów: (a) p o 100 tys. iteracji, (b) po 5 mln. itera cji ze zb yt wysokimi parametrami uczenia. T abela 1 przedstawia ze sta wienie na jlepszych uzysk an yc h wynik ó w. Rezultat dla sieci 200 × 200 wygląda satysfak cjon ująco, jednak należy zwró cić uw agę, że 5 milionów iteracji alg orytmu po chłonęło znacznie pona d jedną dobę. 7 Rozmiar sieci Liczba iteracji 100 × 100 200 × 200 1 000 000 1 go dz. 22 min. 6 go dz. 29 min. 5 000 000 7 go dz. 16 min. 3 1 g o dz. 21 min. T abela 1: Zestawienie rezultatów i cza sów wykon yw ania algorytmu SOMN dla p o danyc h r ozmiarów sieci oraz liczby itera cji na przykładzie fotografii gmac hu węgierskiego parlamen tu. Zupe ł nie inny charakter cech uje kolejną fotog rafię przedstawia jącą parysk ą bazylikę Sacré-Cœ ur (Rysunek 6). Zdjęcie zo stało wykonane no cą, zatem o dwzor ow anie ciemnego nieba skon trastow anego z jasną elewacją kościoła sta no wi k ompletnie odmienne zadanie dla SOMN w stosunku do po przedniego przykładu. T rudność w o dwzor ow aniu dużych p ól jednako w ego o dcienia skutkuje występ o waniem a rtefaktów, wi- do czn ych na p oniższym rysunku: Artefakty s zczególnie widoczne s ą w przypadku sieci o rozmiara c h 100 × 100 węzłów, mniej z a ś dla rozmiaru 200 × 200 (por . T abela 2). 8 Rysunek 6: Obra z wejściowy w s k ali szaro ści ( 46 0 × 480 pikseli). Rysunek 7: Artefakty wido czne na dużych pola c h tego samego o dcienia. Jako os tatni pr zykład weźmiem y p o d uw agę fotog rafię po mnik a Mik oła ja Koper nik a w T oruniu (Rysunek 8). Po do bnie jak w p oprzednich przypa dk ach , na jlepsze o dwzorowanie detali uzys k ujem y p o pięciu milionach iteracji algory tm u dla sieci o rozmiar ze 200 × 20 0 węzłów. Odwzo row anie detali ry sów tw arzy , jak również liści drzew na drugim planie jest bliskie orygina łowi. Brak ro zległych p ól jednako w ego o dcienia p ow o duje, że na uzy sk anym o brazie nie o dna jdujemy niep ożąda n yc h ar tefaktów. Z esta wienie uzys k an ych rezultatów przedstawiono w T ab eli 3. 5 K onkluzje Niniejsza publik acja o parta jest w znacznej mierze na pracy magis ter skiej autora [2] napisanej p o d k ier unkiem prof. T omasza Sc hreib era na Uniw ersytecie Mik oła ja K oper nik a w T oruniu. Jako dane w ejściow e dla pro cesu klasteryza cji z użyciem SOM N wykorzystane zo s tały obrazy cyfrowe w sk a li szaroś c i. W arto zwró cić uw agę, że reprezentacja obrazu przy p omo cy sieci neuronów jest bardzo użyteczna dla potrzeb analizow ania wzo rców (ang. p attern matching ), eksploracji da nych (ang. data mining ) czy kompresji. Prze ds ta wione przy kłady p ok azują, że o dp owiednio nauczone SOMN mogą być z p ow odzeniem 9 Rozmiar sieci Liczba iteracji 100 × 100 200 × 200 1 000 000 1 go dz. 4 min. 5 go dz. 57 min. 5 000 000 6 go dz. 32 min. 28 go dz. 11 min. T abela 2: Zestawienie rezultatów i cza sów wykon yw ania algorytmu SOMN dla p o danyc h r ozmiarów sieci oraz liczby itera cji na przykładzie fotografii bazyliki Sacré-Cœur. Rysunek 8: Obra z wejściowy w s k ali szaro ści ( 64 0 × 480 pikseli). 10 Rozmiar sieci Liczba iteracji 100 × 100 200 × 200 1 000 000 1 go dz. 31 min. 6 go dz. 27 min. 5 000 000 7 go dz. 8 min. 31 go dz. 55 min. T abela 3: Zestawienie rezultatów i cza sów wykon yw ania algorytmu SOMN dla p o danyc h r ozmiarów sieci oraz liczby itera cji na przykładzie fotografii pomnik a Mik oła ja K ope r nik a. wykorzystane do r eprezent acji obrazów cyfrowych w sk ali szarości. Literatura [1] A. C. C. Co olen, R. Kühn, a nd P . Sollich. The ory of Neur al Information Pr o c essing S ystems . Oxford Univ ersity Press, 20 05. [2] P . Filipiak. Samo orga nizujące się sieci mieszankow e w reprezentacji obrazów cyfrowyc h. Master’s thesis, Uniw ersytet Mikoła ja K oper nik a w T oruniu, 2010. [3] T. K ohonen. The self-o rganizing map. Pr o c e e dings of t he IEEE , 7 8 (9):1464–1 478, 1 990. [4] T. K ohonen. S elf-Or ganizing Maps . Springer, 2001. [5] H. Yin a nd N. M. Allinson. B a yesian lea rning for se lf-o rganizing ma p. Ele ctr onic L etters , 3 3(4):304–3 05, 1997. [6] H. Yin and N. M. Allinson. Self-orga nizing mixture net w orks for probability density estimation. IEEE T r a nsactions on Neur al Networks , 12(2):405 –411, 200 1. 11

Original Paper

Loading high-quality paper...

Comments & Academic Discussion

Loading comments...

Leave a Comment